Das Bewusstsein: Hier, dort und überall? – Giulio Tononi, Christof Koch

Zusammenfassung

Die Wissenschaft des Bewusstseins hat große Fortschritte gemacht, indem sie sich auf die Verhaltens- und neuronalen Korrelate der Erfahrung konzentriert hat. Diese Korrelate sind zwar wichtig, um Fortschritte zu erzielen, reichen aber nicht aus, um auch nur grundlegende Fakten zu verstehen, z. B. warum die Großhirnrinde Bewusstsein hervorruft, das Kleinhirn aber nicht, obwohl es noch mehr Neuronen hat und genauso kompliziert zu sein scheint. Darüber hinaus sind Korrelate in vielen Fällen, in denen wir wissen möchten, ob Bewusstsein vorhanden ist, wenig hilfreich: bei Patienten mit einigen wenigen verbliebenen Inseln funktionsfähiger Großhirnrinde, bei Frühgeborenen, bei Nicht-Säugetierarten und bei Maschinen, die den Menschen beim Autofahren, beim Erkennen von Gesichtern und Gegenständen und beim Beantworten schwieriger Fragen rasch übertreffen. Um diese Fragen anzugehen, brauchen wir nicht nur mehr Daten, sondern auch eine Theorie des Bewusstseins – eine Theorie, die erklärt, was Erfahrung ist und welche Art von physikalischen Systemen sie haben können. Die Integrierte Informationstheorie (IIT) geht dabei von der Erfahrung selbst aus und stützt sich auf fünf phänomenologische Axiome: intrinsische Existenz, Zusammensetzung, Information, Integration und Ausschluss. Daraus leitet sie fünf Postulate über die Eigenschaften ab, die physikalische Mechanismen aufweisen müssen, um Bewusstsein zu ermöglichen. Die Theorie liefert eine prinzipielle Erklärung sowohl für die Quantität als auch für die Qualität einer individuellen Erfahrung (einer Quale) und ein Kalkül, mit dem sich beurteilen lässt, ob ein bestimmtes physikalisches System ein Bewusstsein hat oder nicht und in welcher Hinsicht. Darüber hinaus kann die IIT eine Reihe von klinischen und Laborbefunden erklären, macht eine Reihe von überprüfbaren Vorhersagen und lässt sich auf eine Reihe von problematischen Bedingungen extrapolieren. Die Theorie besagt, dass das Bewusstsein eine grundlegende Eigenschaft ist, die physikalische Systeme mit spezifischen kausalen Eigenschaften besitzen. Sie sagt voraus, dass das Bewusstsein abgestuft ist, unter biologischen Organismen verbreitet ist und in einigen sehr einfachen Systemen auftreten kann. Umgekehrt wird vorausgesagt, dass Feed-Forward-Netzwerke, selbst komplexe, kein Bewusstsein haben, ebenso wenig wie Aggregate wie Gruppen von Individuen oder Sandhaufen. In krassem Gegensatz zu den weit verbreiteten funktionalistischen Überzeugungen impliziert die IIT auch, dass digitale Computer, selbst wenn ihr Verhalten dem unseren funktional äquivalent wäre und selbst wenn sie das menschliche Gehirn originalgetreu simulieren würden, so gut wie nichts erfahren würden.

1. Das Bewusstsein: Hier, dort und überall?

Ich weiß, dass ich bewusst bin: Ich sehe, höre, fühle etwas hier, in meinem eigenen Kopf. Aber ist das Bewusstsein – die subjektive Erfahrung – auch dort, nicht nur in den Köpfen anderer Menschen, sondern auch in den Köpfen von Tieren? Und vielleicht überall, den Kosmos durchdringend, wie in alten panpsychistischen Traditionen und in dem Lied der Beatles? Obwohl diese Art von Fragen wissenschaftlich unangemessen erscheinen mag, argumentieren wir im Folgenden, dass sie auf eine prinzipielle und überprüfbare Weise angegangen werden können. Darüber hinaus ist es dringend notwendig, eine Antwort zu finden, nicht nur wegen schwieriger klinischer Fälle und unserer Interaktionen mit anderen Spezies, sondern auch wegen des Aufkommens von Maschinen, die dem Turing-Test immer näher kommen – Computer, die so programmiert sind, dass sie viele Aufgaben genauso gut erledigen können wie wir und oft viel besser als einige hirngeschädigte Patienten.

2. Hier

Dass ich hier und jetzt bewusst bin, ist die einzige Tatsache, derer ich mir absolut sicher bin – alles andere sind Vermutungen. Dies ist natürlich der Kern der berühmtesten Schlussfolgerung des westlichen Denkens, Descartes‘ je pense, donc je suis. Alles andere – was ich über meinen Körper, über andere Menschen, Hunde, Bäume, Berge und Sterne zu wissen glaube – ist eine Schlussfolgerung. Es ist eine vernünftige Schlussfolgerung, die zunächst durch die Überzeugungen meiner Mitmenschen und dann durch die intersubjektiven Methoden der Wissenschaft untermauert wird. Doch das Bewusstsein selbst – die zentrale Tatsache der Existenz – verlangt immer noch nach einer rationalen Erklärung.

Die letzten zwei Jahrhunderte klinischer und labortechnischer Studien haben eine enge Beziehung zwischen dem Bewusstsein und dem Gehirn offenbart, aber die genaue Natur dieser Beziehung bleibt rätselhaft. Warum ist das Gehirn mit dem Bewusstsein verbunden, nicht aber die Leber oder das Herz, wie frühere Kulturen glaubten? Warum bestimmte Teile des Gehirns und nicht andere? Warum geht das Bewusstsein in manchen Schlafstadien verloren? Warum fühlt sich Rot wie Rot an und nicht wie der Klang einer Geige? Ist das Bewusstsein nur ein Epiphänomen, oder hat es eine Funktion? Können Computer ein Bewusstsein haben? Könnte sich ein System wie wir verhalten und dennoch ohne Bewusstsein sein – ein Zombie? Solche Fragen scheinen sich dem empirischen, reduktionistischen Ansatz zu widersetzen, der bei anderen Aspekten der natürlichen Welt so erfolgreich war. Dank der experimentellen und theoretischen Fortschritte der letzten Jahrzehnte [1-5] sind wir jedoch in der Lage, besser zu verstehen, welche Systeme unter welchen Bedingungen ein Bewusstsein haben können. Das heißt, die Erforschung des Bewusstseins wird zu einer Wissenschaft. Dabei lässt sie das defätistische Diktum des Physiologen Emil du Bois-Reymond, ignoramus et ignorabimus (wir wissen es nicht und werden es nie wissen), hinter sich und tritt stattdessen für die optimistische Maxime des Mathematikers David Hilbert ein: Wir müssen wissen – wir werden wissen.

3. Dort

Normalerweise sprechen wir anderen Menschen ein Bewusstsein zu – das gleiche, das wir in der Privatsphäre unseres eigenen Geistes erleben -, wenn sie uns sagen können, was sie fühlen, oder wenn sie mehr oder weniger wie wir aussehen und sich verhalten. Allerdings trauen wir uns immer weniger zu, denjenigen, die nicht über ihre Erfahrungen sprechen können, wie Säuglingen oder schwer hirngeschädigten Patienten, ein Bewusstsein zuzuschreiben. Viele gehen davon aus, dass Tiere, die eng mit dem Homo sapiens verwandt sind – Affen und andere Primaten – ein Bewusstsein haben, wenn auch vermutlich weniger als wir, was auf die Ähnlichkeit ihres Verhaltens und ihres Gehirns zurückzuführen ist. Aber sollten wir allen Säugetieren1, allen Wirbeltieren, wirbellosen Tieren wie Kopffüßern und Bienen oder sogar allen vielzelligen Tieren Erfahrung zuschreiben? Was ist mit kultivierten Organoiden, die die zelluläre Organisation des sich entwickelnden menschlichen Gehirns nachahmen [8]? Und was ist schließlich mit den hochentwickelten Maschinen, die mit Software arbeiten, die den bewussten Menschen bei vielen komplizierten Aufgaben ersetzen soll?

(a) Verhaltenskorrelate von Bewusstsein und Meldefähigkeit

Traditionell beurteilen wir das Bewusstsein durch Beobachtung des Verhaltens (Abbildung 1a). Wenn jemand wach ist und sinnvoll handelt, haben wir kaum Zweifel, dass er bei Bewusstsein ist. Wenn er spricht und vor allem, wenn er Fragen darüber beantworten kann, was ihm bewusst ist, sind wir voll und ganz überzeugt. Im Labor ist die Fähigkeit, über die eigenen Erfahrungen zu berichten, zum Goldstandard für die Beurteilung des Vorhandenseins von Bewusstsein geworden. Die Berichtsfähigkeit wird oft auf eine binäre Zwangsauswahl reduziert, bei der die Versuchsperson einen von zwei Knöpfen für ‚gesehen‘ oder ’nicht gesehen‘ oder ‚wütendes Gesicht‘ oder ‚glückliches Gesicht‘ drückt. Man kann die Versuchspersonen auch fragen, wie zuversichtlich sie in ihren Urteilen sind (confidence rating [10]), sie bitten, ihre Erfahrungen näher zu beschreiben (perceptual awareness scale [11,12]), oder sie auffordern, nach jeder Antwort ein wirtschaftliches Urteil zu fällen (post-decision wagering [13]). Diese Art von metakognitiven und vertrauensvollen Berichten können auch von trainierten Affen und anderen Tieren erhalten werden, die so viele Ähnlichkeiten mit unseren eigenen Berichten aufweisen, dass es kaum Zweifel am Vorhandensein von Bewusstsein gibt [14,15] (siehe jedoch [16]).

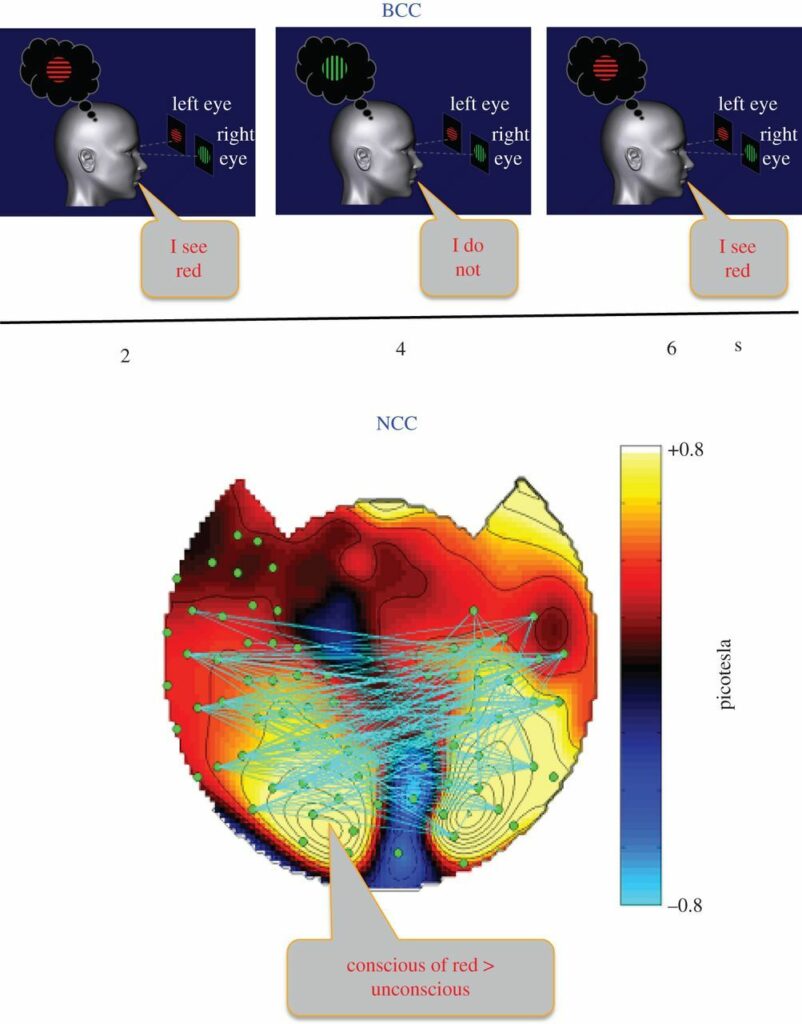

Abbildung 1. Verhaltensbedingte (BCC) und neuronale Korrelate des Bewusstseins (NCC). Die obere Reihe zeigt ein schematisches Diagramm eines binokularen Rivalitätsexperiments. Während des gesamten Experiments wird dem linken Auge ein horizontales rotes Gitter und dem rechten Auge ein vertikales grünes Gitter gezeigt (mit freundlicher Genehmigung von Naotsugu Tsuchiya und Olivia Carter). Die Versuchsperson sieht nicht beide Reize nebeneinander, sondern nimmt entweder das rote oder das grüne Gitter wahr und wechselt alle paar Sekunden hin und her. Auch wenn sich die Reize nicht ändern, ändert sich das, was man bewusst sieht, wie aus dem Bericht der Versuchsperson hervorgeht. Die untere Reihe zeigt die Ergebnisse eines Experiments mit Magnetoenzephalographie (MEG), bei dem das rote Gitter mit einer Frequenz und das grüne mit einer anderen Frequenz geblitzt wurde. Gelb markiert die Bereiche des Kortex (von oben gesehen), die bei der Frequenz des roten Gitters mehr Leistung hatten, wenn es wahrgenommen wurde, als wenn es nicht wahrgenommen wurde. Die cyanfarbenen Linien zeigen eine erhöhte Kohärenz (Synchronisation) zwischen entfernten Hirnregionen an, die mit dem Erleben des Gitters verbunden sind (aus [9]).

Doch das Verhalten kann in die Irre führen: Eine Person kann sich im Schlaf bewegen und sprechen, doch es ist recht zweifelhaft, ob sie etwas erlebt. Oder eine Person schläft, ist unbeweglich, schweigsam und nicht ansprechbar, träumt aber vielleicht und ist sich einer imaginären Umgebung bewusst. In solchen Fällen kann die Berichtbarkeit als retrospektiver Bewusstseinsnachweis verwendet werden, indem der Schlafende geweckt wird, um einen „Traumbericht“ zu erhalten. Aber auch die Berichtbarkeit kann problematisch sein. Da wir in Träumen offensichtlich Dinge erleben, unabhängig davon, ob wir geweckt werden, um sie zu berichten, sollten wir die Möglichkeit akzeptieren, dass in bestimmten Situationen Bewusstsein vorhanden sein kann, auch wenn es nicht berichtet wird [17,18]. Darüber hinaus erhebt das Beharren auf der Berichtbarkeit die Sprache zu einem Königsmacher, was den Rückschluss auf das Bewusstsein bei nonverbalen Säuglingen, Frühgeborenen, Föten oder Tieren problematisch macht.2 Wenn wir verstehen wollen, was wirklich vor sich geht, müssen wir natürlich auch die Gehirnmechanismen untersuchen, die dem Bewusstsein zugrunde liegen.

(b) Neuronale Korrelate des Bewusstseins

Die neuronalen Korrelate des Bewusstseins (NCC) wurden als die minimalen neuronalen Mechanismen definiert, die gemeinsam für jede bewusste Wahrnehmung, jeden Gedanken oder jede Erinnerung unter konstanten Hintergrundbedingungen ausreichen (Abbildung 1b) [1,23,24]. Letztere sind die distalen oder proximalen Ermöglichungsfaktoren, die vorhanden sein müssen, damit eine bewusste Erfahrung stattfinden kann – das Herz muss schlagen und das Gehirn mit sauerstoffreichem Blut versorgen, verschiedene Kerne in der retikulären Formation des Mittelhirns und des Hirnstamms müssen aktiv sein [25-27], die Freisetzung von Cholinergika muss im kortiko-thalamischen Komplex stattfinden [28] und so weiter.

Jede Erfahrung hat ein assoziiertes NCC: eines für das Sehen eines roten Flecks, ein anderes für das Hören eines hohen C. Die Induzierung des NCC durch Manipulation der relevanten Neuronenpopulationen mittels magnetischer Stimulation, Optogenetik oder anderer Mittel wird die assoziierte bewusste Wahrnehmung hervorrufen. Eine Störung des NCC durch Ausschalten der zugrundeliegenden neuronalen Schaltkreise führt zur Beseitigung der Wahrnehmung.

Die NCC werden in der Regel bewertet, indem festgestellt wird, welche Aspekte der neuronalen Funktion sich ändern, je nachdem, ob eine Person bei Bewusstsein ist oder nicht, wie anhand von Verhaltensberichten festgestellt wurde. Dies kann durch die Betrachtung einer globalen Veränderung des Bewusstseins erfolgen, wie z. B. beim Verlust des Bewusstseins während des Tiefschlafs oder einer Vollnarkose [29,30]. Oder es kann eine Veränderung eines bestimmten Bewusstseinsinhaltes betrachtet werden, z. B., wenn das Bewusstsein einer Versuchsperson für einen bestimmten Reiz experimentell manipuliert wird („gesehen“ versus „nicht gesehen“ [31,32]). In optimal kontrollierten Experimenten werden der Stimulus und der Verhaltensbericht (z. B. ein Tastendruck) konstant gehalten, während die Versuchsperson die Wahrnehmung manchmal sieht und manchmal nicht [3,33,34]. Sobald ein bestimmtes NCC hinreichend validiert ist, kann es zur Extrapolation auf Situationen verwendet werden, in denen keine Berichte verfügbar sind. Sowohl die funktionelle Hirnbildgebung mit Magnetscannern als auch hochauflösende Elektroenzephalographie (EEG) von außerhalb des Schädels wurden eingesetzt, um die Spuren des Bewusstseins im Gehirn gesunder erwachsener Beobachter aufzuspüren. Beliebte Kandidaten sind eine starke Aktivierung der hochrangigen fronto-parietalen Kortexe (Abbildung 1b), hochfrequente elektrische Aktivität im Gamma-Bereich (35-80 Hz) und das Auftreten eines EEG-Ereignisses, das als P300-Welle bekannt ist [1,3,29]. Es besteht jedoch immer noch kein Konsens darüber, ob eines dieser Zeichen als verlässliche „Signatur“ des Bewusstseins angesehen werden kann. Insbesondere kann es Bewusstsein ohne Beteiligung des frontalen Kortex geben [35-37], Gamma-Aktivität ohne Bewusstsein [38], z. B. während einer Narkose [39,40], und Bewusstsein ohne frontale P300-Welle, z. B. im Traumschlaf [41,42]. Darüber hinaus ist es wahrscheinlich, dass viele der Signaturen, die als mögliche NCC vorgeschlagen werden, in Wirklichkeit Korrelate neuronaler Aktivität sind, die im Vorfeld einer bewussten Wahrnehmung [43,44] oder für einen Bericht im Anschluss an eine bewusste Wahrnehmung [36,37,44] erforderlich ist, und nicht für eine Erfahrung. Eine große Herausforderung besteht darin, kognitive Funktionen wie selektive Aufmerksamkeit, Gedächtnis, Entscheidungsfindung und Aufgabenüberwachung konstant zu halten, um das „nackte“ Substrat des Bewusstseins auf der neuronalen Ebene zu isolieren [45,46]. Schließlich können die an gesunden Erwachsenen gewonnenen Erkenntnisse über das Bewusstsein auf hirngeschädigte Patienten, Säuglinge, Tiere, die sich sehr von uns unterscheiden, und nicht zuletzt auf Maschinen übertragen werden (Abbildung 2).

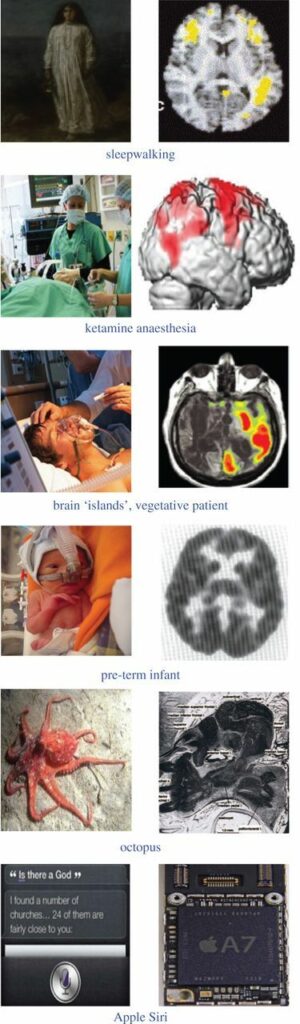

Abbildung 2. Sechs Fälle, in denen es zunehmend schwieriger wird, auf das Vorhandensein von Bewusstsein zu schließen, da sich das Verhaltensrepertoire und die zugrundeliegenden Mechanismen (Gehirne) erheblich von denen typischer Personen unterscheiden, die über ihre Erfahrungen sprechen können (Abbildung 1).

c) Patienten und Kinder

Patienten mit ausgedehnten kortikalen oder thalamischen Schäden stellen eine große Herausforderung dar. Das Personal in der Notaufnahme bewertet den Schweregrad einer Kopfverletzung schnell anhand des Verhaltens, indem es den auditiven, visuellen, verbalen und motorischen Funktionen sowie dem Kommunikations- und Erregungsniveau des Patienten eine Zahl zuweist. Verschiedene NCC, wie z. B. das Vorhandensein einer P300-Welle als Reaktion auf einen nicht standardisierten Stimulus, werden zunehmend zur Ergänzung der Verhaltensbeurteilung und gelegentlich zur Änderung der Diagnose eingesetzt. In einigen Fällen kann das NCC entscheidend sein. Wenn also ein Patient, der stumm und unbeweglich liegt, dennoch auf Befehle reagieren kann, indem er bestimmte Hirnareale entsprechend aktiviert, kann man davon ausgehen, dass er bei Bewusstsein ist [47]. Die meisten der vorgeschlagenen „Signaturen“ des Bewusstseins sind jedoch unzureichend. So fehlt beispielsweise die P300-Welle bei vielen Patienten mit minimalem Bewusstsein und sogar bei einigen hirngeschädigten Patienten, die kommunizieren können [48]. Und was ist von Patienten zu halten, bei denen inmitten einer weit verbreiteten Zerstörung und Inaktivität ein oder wenige isolierte kortikale Bereiche Anzeichen für eine metabolische Aktivierung und elektrophysiologische „Marker“ des Bewusstseins zeigen [49]? Reicht eine Insel mit funktionierendem Hirngewebe aus, um eine begrenzte Art von Bewusstsein zu erzeugen, vielleicht nur ein Bewusstsein für Geräusche oder Schmerzen? Mit anderen Worten: Wie fühlt es sich an, eine Hirninsel zu sein, wenn es sich überhaupt so anfühlt? Und wie groß muss die Insel sein, um als solche zu gelten?

Wie ist es, ein neugeborenes Baby mit einem unreifen Gehirn und eingeschränkter Konnektivität zwischen den kortikalen Strukturen zu sein [50]? Auch hier kann die Betrachtung des NCC hilfreich sein: So wurde beispielsweise bei sechs bis 16 Monate alten Säuglingen eine Welle beobachtet, die der P300-Welle ähnelt, allerdings schwächer, variabler und verzögert im Vergleich zu Erwachsenen [51]. Bedeutet dies jedoch, dass Neu- und Frühgeborene oder sogar Föten nichts erleben, weil sie keine P300-Welle aufweisen?

(d) Tiere

Das Problem wird noch akuter, wenn man sich anderen Arten zuwendet. Die Erforschung des Bewusstseins in der Natur wurde jahrhundertelang durch den festen Glauben an den menschlichen Ausnahmezustand behindert. Doch die Vielfalt und Komplexität des Verhaltens von Tieren hat diesen Glauben zumindest unter Biologen zu Grabe getragen. Dies gilt insbesondere für Säugetiere. Bei psychophysikalischen Aufgaben, bei denen einfache Knöpfe gedrückt werden müssen, verhalten sich trainierte Makakenaffen sehr ähnlich wie menschliche Probanden und signalisieren auch, wenn sie nichts sehen [14]. Visuelle Selbstwahrnehmung, Metakognition (Wissen um die eigene Meinung), Theory of Mind, Empathie und langfristige Planung wurden bei Primaten, Nagetieren und anderen Ordnungen nachgewiesen [52].

Es ist auch schwierig, etwas Außergewöhnliches am menschlichen Gehirn zu finden [53]. Seine konstitutiven Gene, Synapsen, Neuronen und anderen Zellen ähneln denen vieler anderer Arten. Selbst seine Größe ist nichts Besonderes, denn Elefanten, Delfine und Wale haben noch größere Gehirne [54]. Nur ein erfahrener Neuroanatom, der mit einem Mikroskop bewaffnet ist, kann ein korngroßes Stück Neokortex einer Maus von dem eines Affen oder eines Menschen unterscheiden. Biologen betonen diese strukturelle und verhaltensmäßige Kontinuität, indem sie zwischen nichtmenschlichen und menschlichen Tieren unterscheiden [55]. In Anbetracht dieser Kontinuität scheint es ungerechtfertigt zu behaupten, dass nur eine Spezies ein Bewusstsein hat, während alle anderen keine Erfahrung haben, also Zombies sind. Es ist viel wahrscheinlicher, dass alle Säugetiere zumindest einige bewusste Erfahrungen haben; die Geräusche hören und die „Sehenswürdigkeiten“ des Lebens sehen können.

Wenn wir Arten betrachten, die in evolutionärer und neuronaler Hinsicht immer weiter vom Homo sapiens entfernt sind, wird es schwieriger, ein Bewusstsein zu begründen. Zwei Beobachtungen, die sich zum einen auf die Komplexität des Verhaltens und zum anderen auf die Komplexität des zugrunde liegenden Nervensystems beziehen, sind entscheidend. Erstens sind Raben, Krähen, Elstern, Papageien und andere Vögel, Thunfische, Quastenflosser und andere Fische, Tintenfische und andere Kopffüßer, Bienen und andere Mitglieder der riesigen Klasse der Insekten alle zu hochentwickelten, erlernten, nicht stereotypen Verhaltensweisen fähig, die wir mit Bewusstsein in Verbindung bringen, wenn sie von Menschen ausgeführt werden [56-58]. Darwin selbst machte sich auf den Weg, „um herauszufinden, inwieweit die Würmer bewusst handeln“, und kam zu dem Schluss, dass es keine absolute Schwelle zwischen „niederen“ und „höheren“ Tieren, einschließlich des Menschen, gibt, die den einen höhere geistige Fähigkeiten zuordnen würde, den anderen aber nicht [59]. Zweitens weisen die Nervensysteme dieser Tierarten eine enorme und noch unverstandene Komplexität auf. Die Biene enthält etwa 800.000 Nervenzellen, deren morphologische und elektrische Heterogenität mit der eines neokortikalen Neurons vergleichbar ist. Diese Zellen sind in hochgradig nichtlinearen Rückkopplungskreisen zusammengefasst, deren Dichte bis zu zehnmal höher ist als die des Neokortex [60]. Neuronale Signaturen des Bewusstseins, die bei Menschen und anderen Säugetieren eine gewisse Gültigkeit haben, gelten daher möglicherweise überhaupt nicht für wirbellose Tiere.

Andererseits müssen uns die Lehren, die wir aus der Untersuchung des Verhaltens (BCC) und der neuronalen Korrelate des Bewusstseins beim Menschen gezogen haben, zur Vorsicht mahnen, wenn es darum geht, auf das Vorhandensein von Bewusstsein bei Lebewesen zu schließen, die sich stark von uns unterscheiden – unabhängig davon, wie ausgefeilt ihr Verhalten und wie kompliziert ihr Gehirn ist. Menschen können komplexe Verhaltensweisen ausführen – erkennen, ob eine Szene kongruent oder inkongruent ist, die Größe, Ausrichtung und Stärke des Fingers beim Greifen eines Objekts kontrollieren, einfache Rechenoperationen durchführen, die Bedeutung von Wörtern erkennen oder schnell auf der Tastatur tippen – und das scheinbar unbewusst [61-66]. Wenn eine Biene durch ein Labyrinth navigiert, tut sie das dann so, wie wenn wir bewusst überlegen, ob wir nach rechts oder links gehen, oder eher so, wie wenn wir auf einer Tastatur tippen? Ähnlich verhält es sich mit einer außerordentlich komplizierten neuronalen Struktur in unserem Gehirn, dem Kleinhirn, das 69 der 86 Milliarden Nervenzellen beherbergt, aus denen das menschliche Gehirn besteht [54], und das offenbar wenig mit dem Bewusstsein zu tun hat. Patienten, die durch einen Schlaganfall oder ein anderes Trauma einen Teil oder fast ihr gesamtes Kleinhirn verlieren, zeigen Ataxie, undeutliches Sprechen und unsicheren Gang [67], klagen aber nicht über einen Verlust oder eine Beeinträchtigung des Bewusstseins. Ist der zentrale Hirnkomplex der Biene in Bezug auf das Erleben eher mit dem Kleinhirn oder eher mit der Großhirnrinde vergleichbar? Inwieweit Nicht-Säugetierarten mit uns die Gabe der subjektiven Erfahrung teilen, bleibt also schwer zu ergründen.3

(e) Maschinen

Die Schwierigkeiten bei der Zuschreibung von Bewusstsein werden noch deutlicher, wenn man digitale Computer betrachtet. Diese haben eine völlig andere Architektur und Herkunft als biologische Organismen, die durch natürliche Selektion entstanden sind. Dank der unaufhaltsamen Verkleinerung der Transistoren in den letzten 50 Jahren und der damit einhergehenden exponentiellen Zunahme der Rechenleistung und der Speicherkapazität sind die heutigen Computer, die geeignete Algorithmen ausführen, uns in vielen Aufgaben überlegen, von denen man dachte, sie seien allein dem menschlichen Geist vorbehalten. Prominente Beispiele sind der IBM-Computer Deep Blue, der 1997 den amtierenden Schachweltmeister besiegte; ein weiterer IBM-Computer, Watson, der Fragen in gesprochenem Englisch beantworten kann und 2011 die Quizshow Jeopardy gewann; Smartphones, die Fragen per Sprache beantworten; fahrerlose Autos von Google, die bereits mehr als eine halbe Million Kilometer auf offenen Straßen zurückgelegt haben, und Algorithmen für das maschinelle Sehen zur Gesichtserkennung in Sicherheits- und kommerziellen Anwendungen [68]. Es wird davon ausgegangen, dass Menschen, die Schach spielen, sinnvolle Antworten auf Fragen geben, ein Auto fahren oder ein Gesicht erkennen, ein Bewusstsein haben. Aber sollten wir das auch für diese digitalen Kreaturen behaupten?

4. Integrierte Informationstheorie

Je weiter wir uns vom Menschen entfernen, desto weniger hilfreich sind BCC und NCC, um das Vorhandensein von Bewusstsein nachzuweisen. Selbst im normalen menschlichen Gehirn müssen wir verstehen, warum und wie bestimmte Strukturen mit Erfahrung assoziiert werden (die Großhirnrinde oder möglicherweise das Klaustrum [69,70]) und andere nicht (das Kleinhirn), und warum sie dies unter bestimmten Bedingungen tun (Wachzustand, Träume) und unter anderen nicht (Tiefschlaf, Anfälle). Einige Philosophen haben behauptet, dass das Problem, zu erklären, wie Materie Bewusstsein hervorbringen kann, uns für immer entgehen könnte, und haben es als das „Hard-Problem“ bezeichnet [71-73]. Solange man vom Gehirn ausgeht und fragt, wie es zu Erfahrungen kommen kann – also versucht, den Geist aus der Materie zu „destillieren“ [74] -, könnte das Problem nicht nur schwierig, sondern fast unmöglich zu lösen sein. Weniger schwierig wird es, wenn man den umgekehrten Ansatz wählt: Man geht vom Bewusstsein selbst aus, indem man seine wesentlichen Eigenschaften identifiziert, und fragt dann, welche physikalischen Mechanismen sie möglicherweise erklären könnten. Diesen Ansatz verfolgt die integrierte Informationstheorie (IIT) [75-79], ein sich entwickelnder formaler und quantitativer Rahmen, der eine prinzipielle Erklärung für die Entstehung des Bewusstseins liefert, eine schlüssige Erklärung für die empirische Evidenz bietet, prüfbare Vorhersagen macht und Rückschlüsse und Extrapolationen erlaubt (Tabelle 1).4

(a) Axiome: wesentliche phänomenologische Eigenschaften des Bewusstseins

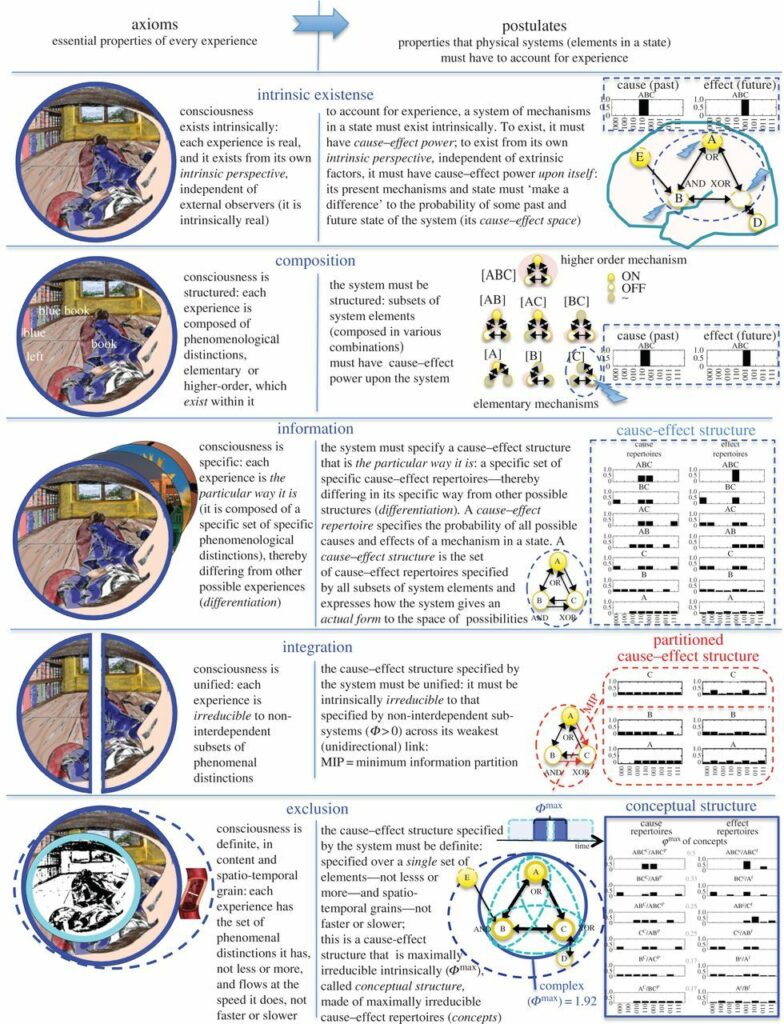

Ausgehend vom Bewusstsein werden in der IIT zunächst Axiome der Erfahrung (Abbildung 3, links) aufgestellt und dann eine Reihe entsprechender Postulate (Abbildung 3, rechts) über das physikalische Substrat abgeleitet [77,80]. Die Axiome der IIT sind Annahmen über unsere eigene Erfahrung, die den Ausgangspunkt für die Theorie bilden. Im Idealfall sind die Axiome wesentlich (sie gelten für alle Erfahrungen), vollständig (sie enthalten alle wesentlichen Eigenschaften, die jeder Erfahrung gemeinsam sind), konsistent (ohne Widersprüche) und unabhängig (sie sind nicht voneinander ableitbar). Ob die derzeitige Gruppe von fünf Axiomen wirklich gültig, vollständig und unabhängig ist, bleibt offen.5 Die fünf Axiome sind intrinsische Existenz, Komposition, Information, Integration und Ausschluss.

Abbildung 3. Axiome und Postulate der integrierten Informationstheorie (IIT). Die Illustration ist eine kolorierte Version von Ernst Machs „Blick vom linken Auge“ [84]. Siehe auch die Mechanismen in Abbildung 4.

(i) Intrinsische Existenz

Das Bewusstsein existiert: meine Erfahrung ist einfach da. In der Tat ist die Tatsache, dass meine Erfahrung hier und jetzt existiert – sie ist real oder tatsächlich – die einzige Tatsache, der ich mir unmittelbar und absolut sicher bin, wie Descartes vor vier Jahrhunderten erkannte. Außerdem existiert meine Erfahrung aus ihrer eigenen intrinsischen Perspektive, unabhängig von externen Beobachtern.

(ii) Zusammensetzung

Das Bewusstsein ist strukturiert: Jede Erfahrung setzt sich aus vielen phänomenologischen Unterscheidungen elementarer oder höherer Ordnung zusammen, die ebenfalls existieren. Innerhalb ein und derselben Erfahrung kann ich zum Beispiel ein Buch, eine blaue Farbe, ein blaues Buch usw. unterscheiden.

(iii) Information

Das Bewusstsein ist spezifisch: Jede Erfahrung ist so, wie sie ist – sie besteht aus einer bestimmten Menge spezifischer phänomenaler Unterscheidungen – und unterscheidet sich dadurch von anderen möglichen Erfahrungen (Differenzierung). So ist eine Erfahrung reiner Dunkelheit und Stille das, was sie ist, weil sie unter anderem nicht mit Licht und Klang, Farben und Formen erfüllt ist, es gibt keine Bücher, keine blauen Bücher und so weiter. Und weil das so ist, unterscheidet sie sich notwendigerweise von einer großen Anzahl anderer Erfahrungen, die ich machen könnte. Denken Sie nur an alle Bilder aller möglichen Filme: Die damit verbundenen visuellen Wahrnehmungen sind nur eine kleine Teilmenge aller möglichen Erfahrungen.

(iv) Integration

Das Bewusstsein ist einheitlich: Jede Erfahrung ist auf nicht voneinander abhängige Teilmengen von phänomenalen Unterscheidungen reduzierbar. So erlebe ich eine ganze visuelle Szene, nicht die linke Seite des Gesichtsfeldes unabhängig von der rechten Seite (und umgekehrt). Zum Beispiel ist die Erfahrung, das Wort „HONEYMOON“ in der Mitte einer leeren Seite geschrieben zu sehen, irreduzibel auf die Erfahrung, „HONEY“ auf der linken Seite zu sehen und die Erfahrung, „MOON“ auf der rechten Seite zu sehen. In ähnlicher Weise ist das Sehen eines blauen Buches irreduzibel auf das Sehen eines grauen Buches plus der körperlosen Farbe Blau.

(v) Ausschluss

Das Bewusstsein ist inhaltlich und räumlich-zeitlich eindeutig: Jede Erfahrung hat die Menge der phänomenalen Unterscheidungen, die sie hat, weder weniger (eine Untermenge) noch mehr (eine Obermenge), und sie fließt mit der Geschwindigkeit, mit der sie fließt, weder schneller noch langsamer. Die Erfahrung, die ich mache, besteht also darin, dass ich einen Körper auf einem Bett in einem Schlafzimmer sehe, ein Bücherregal mit Büchern, von denen eines ein blaues Buch ist, aber ich mache keine Erfahrung mit weniger Inhalt – etwa eine ohne die phänomenale Unterscheidung blau/nicht blau oder farbig/nicht farbig -, und ich mache auch keine Erfahrung mit mehr Inhalt – etwa eine, die mit der zusätzlichen phänomenalen Unterscheidung hoher/niedriger Blutdruck ausgestattet ist. In ähnlicher Weise fließt meine Erfahrung mit einer bestimmten Geschwindigkeit – jede Erfahrung umfasst etwa hundert Millisekunden -, aber ich habe keine Erfahrung, die nur ein paar Millisekunden oder stattdessen Minuten oder Stunden umfasst.

(b) Postulate: Eigenschaften, die physikalische Mechanismen haben müssen, um Bewusstsein zu unterstützen

Parallel zu diesen Axiomen, die die wesentlichen Eigenschaften jeder Erfahrung erfassen, schlägt das IIT eine Reihe von Postulaten vor, die sich auf die Anforderungen beziehen, die jedes physikalische System erfüllen muss, um Erfahrungen zu erklären (Abbildung 3, rechts). Der Einfachheit halber werden physikalische Systeme als Elemente in einem Zustand betrachtet, wie Neuronen oder logische Gatter, die entweder EIN oder AUS sind. Es ist nur erforderlich, dass solche Elemente zwei oder mehr interne Zustände haben, Eingaben, die diese Zustände in einer bestimmten Weise beeinflussen können, und Ausgaben, die wiederum von diesen Zuständen abhängen.

(i) Intrinsische Existenz

Ein System von Mechanismen in einem Zustand muss intrinsisch existieren. Um zu existieren, muss es insbesondere eine Ursache-Wirkungs-Macht haben, denn es hat keinen Sinn anzunehmen, dass etwas existiert, wenn es durch nichts beeinflusst werden oder nichts beeinflussen kann [88].6 Um aus seiner eigenen intrinsischen Perspektive, unabhängig von externen Beobachtern, zu existieren, muss es außerdem eine Ursache-Wirkungs-Macht auf sich selbst haben, unabhängig von extrinsischen Faktoren (Abbildung 3, intrinsische Existenz). Die Ursache-Wirkungs-Macht kann durch die Betrachtung eines Ursache-Wirkungs-Raums mit einer Achse für jeden möglichen Zustand des Systems in der Vergangenheit (Ursachen) und in der Zukunft (Wirkungen) festgestellt werden. Innerhalb dieses Raums genügt es zu zeigen, dass ein „Eingriff“, der das System in einen bestimmten Anfangszustand versetzt, wobei der Zustand der Elemente außerhalb des Systems unverändert bleibt (Hintergrundbedingungen), mit einer vom Zufall abweichenden Wahrscheinlichkeit zu seinem gegenwärtigen Zustand führen kann (Ursache); umgekehrt führt die Versetzung des Systems in seinen gegenwärtigen Zustand mit einer vom Zufall abweichenden Wahrscheinlichkeit zu einem anderen Zustand (Wirkung).

(ii) Zusammensetzung

Das System muss strukturiert sein: Teilmengen der elementaren Mechanismen des Systems, die in verschiedenen Kombinationen zusammengesetzt sind, haben auch eine kausale Kraft innerhalb des Systems. Wenn also ein System ABC aus den Elementen A, B und C besteht (Abbildung 3, Komposition), kann jede Teilmenge von Elementen, einschließlich A, B, C; AB, AC, BC; sowie das gesamte System ABC, einen Mechanismus mit Ursache-Wirkungs-Macht bilden. Die Komposition ermöglicht es, dass elementare Mechanismen (erster Ordnung) verschiedene Mechanismen höherer Ordnung bilden und dass mehrere Mechanismen eine Struktur bilden.

(iii) Informationen

Das System muss eine Ursache-Wirkungs-Struktur spezifizieren, die spezifisch so ist, wie sie ist: eine spezifische Menge spezifischer Ursache-Wirkungs-Repertoires, die sich von anderen möglichen Repertoires unterscheiden (Differenzierung). Ein Ursache-Wirkungs-Repertoire charakterisiert vollständig die Ursache-Wirkungs-Kraft eines Mechanismus innerhalb eines Systems, indem es alle seine Ursache-Wirkungs-Eigenschaften explizit macht. Es kann bestimmt werden, indem das System auf alle möglichen Arten gestört wird, um zu beurteilen, wie ein Mechanismus in seinem gegenwärtigen Zustand die Wahrscheinlichkeit der vergangenen und zukünftigen Zustände des Systems beeinflusst. Die Ursache-Wirkungs-Repertoires, die durch jede Zusammensetzung von Elementen innerhalb eines Systems spezifiziert werden, ergeben zusammen eine Ursache-Wirkungs-Struktur. Betrachten wir zum Beispiel innerhalb des Systems ABC (Abbildung 3, Information) den Mechanismus, der durch das Element C, ein XOR-Gatter mit zwei Eingängen (A und B) und zwei Ausgängen (das ODER-Gatter A und das UND-Gatter B), realisiert wird. Wenn C AUS ist, legt sein Ursachenrepertoire fest, dass sich A und B im vorangegangenen Zeitschritt entweder im Zustand AUS,AUS oder im Zustand EIN,EIN befunden haben müssen, und nicht in den beiden anderen möglichen Zuständen (AUS,EIN; EIN,AUS); und sein Wirkungsrepertoire legt fest, dass B im nächsten Zeitschritt AUS und nicht EIN sein muss. Sein Ursache-Wirkungs-Repertoire ist spezifisch: Es wäre anders, wenn der Zustand von C anders wäre (EIN) oder wenn C ein anderer Mechanismus wäre (z. B. ein UND-Gatter). Ähnliche Überlegungen gelten für jeden anderen Mechanismus des Systems, der durch unterschiedliche Zusammensetzungen von Elementen realisiert wird. Somit spezifiziert das Ursache-Wirkungs-Repertoire die volle Ursache-Wirkungs-Macht eines Mechanismus in einem bestimmten Zustand, und die Ursache-Wirkungs-Struktur spezifiziert die volle Ursache-Wirkungs-Macht eines Systems von Mechanismen. Man beachte, dass sich der Begriff der Information in der IIT wesentlich von dem in der Kommunikationstheorie oder in der Umgangssprache unterscheidet, aber er bleibt seiner Etymologie treu: Information bezieht sich darauf, wie ein System von Mechanismen in einem Zustand durch seine Ursache-Wirkungs-Kraft eine Form im Raum der Möglichkeiten spezifiziert (eine begriffliche Struktur „informiert“).

(iv) Integration

Die durch das System spezifizierte Ursache-Wirkungs-Struktur muss einheitlich sein: Sie muss intrinsisch irreduzibel zu derjenigen sein, die durch nicht voneinander abhängige Teilsysteme spezifiziert wird, die durch unidirektionale Partitionen erhalten werden. Partitionen werden unidirektional vorgenommen, um sicherzustellen, dass die Ursache-Wirkungs-Kraft intrinsisch irreduzibel ist – aus der intrinsischen Perspektive des Systems – was bedeutet, dass jeder Teil des Systems in der Lage sein muss, den Rest des Systems sowohl zu beeinflussen als auch von ihm beeinflusst zu werden. Die intrinsische Irreduzibilität kann als integrierte Information („großes phi“ oder Φ, eine nicht-negative Zahl) gemessen werden, die angibt, inwieweit sich die durch die Mechanismen eines Systems spezifizierte Ursache-Wirkungs-Struktur ändert, wenn das System entlang seiner minimalen Partition (derjenigen, die den geringsten Unterschied macht) partitioniert (geschnitten oder reduziert) wird. Zum Beispiel ist das System in Abbildung 3 integriert, weil die Partitionierung durch das schwächste Glied mehrere Ursache-Wirkungs-Repertoires zerstört und andere verändert (vgl. die Ursache-Wirkungs-Struktur unter „Information“ und unter „Integration“ in Abbildung 3). Wenn dagegen ein System von Mechanismen in zwei Teilsysteme aufgeteilt werden kann und die Teilung keinen Unterschied in der zugehörigen Ursache-Wirkungs-Struktur macht, dann ist das Ganze auf diese Teile reduzierbar. Die inhärente Irreduzibilität ist eine weitere Voraussetzung für die Existenz, die mit der Kausalität zu tun hat: Es hat keinen Sinn anzunehmen, dass das Ganze an und für sich existiert, wenn es keine über seine Teile hinausgehende Ursache-Wirkungs-Kraft hat. Dieses Postulat gilt auch für einzelne Mechanismen: Eine Teilmenge von Elementen kann nur dann einen bestimmten Aspekt der Erfahrung beisteuern, wenn ihr Ursache-Wirkungs-Repertoire innerhalb des Systems durch die minimale Teilung des Mechanismus („kleines phi“ oder φ) irreduzibel ist.

(v) Ausschluss

Die vom System spezifizierte Ursache-Wirkungs-Struktur muss eindeutig sein: Sie wird über eine einzige Menge von Elementen spezifiziert – weder weniger noch mehr -, über die sie aus ihrer intrinsischen Perspektive maximal irreduzibel (Φmax) ist und somit maximalen Anspruch auf Existenz erhebt. Zum Beispiel (Abbildung 3, Ausschluss) könnten innerhalb von ABCDE viele Kandidatensysteme Ursache-Wirkungs-Strukturen spezifizieren, einschließlich AB, AC, BC, ABC, ABCD, ABCDE und so weiter. Unter diesen Systemen ist das System, das die Ursache-Wirkungs-Struktur spezifiziert, die an sich maximal irreduzibel ist, die Menge der Elemente ABC, und nicht irgendeine ihrer Unter- oder Obermengen. Das Ausschlusspostulat liefert einen hinreichenden Grund, warum die Inhalte der Erfahrung so sein sollten, wie sie sind – weder weniger noch mehr. In Bezug auf Kausalität hat dies zur Folge, dass die „siegreiche“ Ursache-Wirkungs-Struktur alternative Ursache-Wirkungs-Strukturen ausschließt, die überlappende Elemente spezifizieren: Wenn ein Mechanismus in einem Zustand (sagen wir A OFF) ein bestimmtes Ursache-Wirkungs-Repertoire innerhalb eines Systems (ABC) spezifiziert, sollte er nicht zusätzlich ein überlappendes Ursache-Wirkungs-Repertoire als Teil anderer, überlappender Systeme (sagen wir AB oder ABCD) spezifizieren, sonst würde man den Unterschied, den dieser Mechanismus macht, mehrfach zählen. Man kann sagen, dass das Ausschlusspostulat Occams Rasiermesser durchsetzt (Entitäten sollten nicht über die Notwendigkeit hinaus vervielfacht werden): Es ist sparsamer, die Existenz einer einzigen Ursache-Wirkungs-Struktur über einem System von Elementen zu postulieren – die maximal irreduzibel ist – als eine Vielzahl von überlappenden Ursache-Wirkungs-Strukturen, deren Existenz keinen weiteren Unterschied machen würde. Das Ausschlusspostulat gilt auch für einzelne Mechanismen: Eine Teilmenge von Elementen in einem Zustand spezifiziert das Ursache-Wirkungs-Repertoire innerhalb des Systems, das maximal irreduzibel ist (φmax), was als Kernkonzept oder kurz Konzept bezeichnet wird. Auch hier kann es nicht zusätzlich ein Ursache-Wirkungs-Repertoire spezifizieren, das sich über dieselben Elemente erstreckt, da sonst der Unterschied, den ein Mechanismus macht, mehrfach gezählt würde. Eine maximal irreduzible Ursache-Wirkungs-Struktur, die sich aus Konzepten zusammensetzt, wird als konzeptuelle Struktur bezeichnet. Das System von Mechanismen, das eine begriffliche Struktur spezifiziert, wird als Komplex bezeichnet.7 Es ist sinnvoll, sich eine begriffliche Struktur als eine Form im Ursache-Wirkungs-Raum vorzustellen, deren Achsen durch alle möglichen vergangenen und zukünftigen Zustände des Komplexes gegeben sind. In diesem Raum ist jeder Begriff ein Punkt (Stern), dessen Größe durch seine Irreduzibilität φmax gegeben ist, und eine begriffliche Struktur ist eine „Konstellation“ von Punkten, d. h. eine Form. Schließlich gilt dieses Postulat auch für räumlich-zeitliche Körner. So kann ein Mechanismus beispielsweise keine Wirkungen auf einer feinen zeitlichen Ebene und zusätzlichen Wirkungen auf einer gröberen Ebene haben, da sonst der kausale Ausschluss verletzt würde. Wenn andererseits die Wirkungen auf einem gröberen Korn irreduzibler sind als die auf einem feineren, dann schließt das gröbere Kausalkorn das feinere aus [79].8

(c) Die zentrale Identität: Erfahrung als begriffliche Struktur

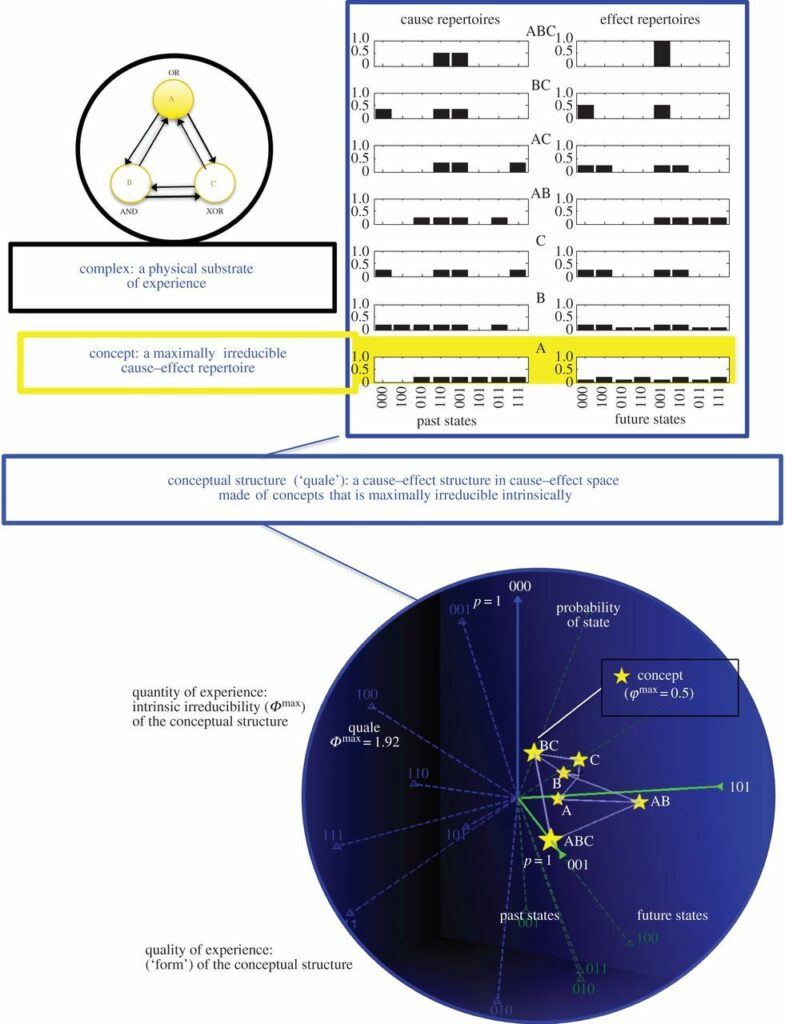

Insgesamt bilden die Elemente eines Komplexes in einem Zustand, die zu Mechanismen höherer Ordnung zusammengesetzt sind, die Begriffe spezifizieren, eine konzeptuelle Struktur, die intrinsisch maximal irreduzibel ist und auch als Quale bezeichnet wird. Die Konstellation aller Konzepte spezifiziert die Gesamtform oder Gestalt der Quale (Abbildung 4).

Abbildung 4. Ein didaktisches Beispiel für die Berechnung der Qualität und Quantität des Bewusstseins bei einem System von Elementen in einem Zustand. Links oben befinden sich drei Gatter mit binären Zuständen (entweder EIN oder AUS: ABC = 100; siehe auch Abbildung 3), die wie dargestellt miteinander verdrahtet sind. Eine Analyse auf der Grundlage der Postulate des IIT [80] zeigt, dass das System einen Komplex bildet. Der Komplex in seinem gegenwärtigen Zustand spezifiziert eine Quale – eine begriffliche Struktur, die intrinsisch maximal irreduzibel ist. Die Quale wird sowohl als die Menge der maximal irreduziblen Ursache-Wirkungs-Repertoires (Konzepte) dargestellt, die von jedem Mechanismus spezifiziert werden (oben), als auch als zweidimensionale Projektion, in der jedes Konzept ein „Stern“ im Ursache-Wirkungs-Raum ist (unten). Der Ursache-Wirkungs-Raum oder Qualia-Raum ist ein hochdimensionaler Raum (hier 2 × 8 Dimensionen), in dem jede Achse ein möglicher vergangener (in blau) und zukünftiger (in grün) Zustand des Komplexes ist, und die Position entlang der Achse die Wahrscheinlichkeit dieses Zustands darstellt. Jedes Konzept ist ein Stern, dessen Position angibt, wie ein Mechanismus, der aus einer Teilmenge von Elementen besteht, die Wahrscheinlichkeit vergangener und zukünftiger Zustände des Systems beeinflusst (sein Ursache-Wirkungs-Repertoire, das angibt, was das Konzept zur Erfahrung beiträgt) und dessen Größe (φmax) misst, wie irreduzibel das Konzept ist (wie viel es zur Erfahrung beiträgt). In der IIT misst Φmax – eine nicht-negative Zahl – die intrinsische Irreduzibilität des gesamten Quals, wie viel Bewusstsein es gibt – die Quantität der Erfahrung. Die „Form“ oder Gestalt der Quale (Sternenkonstellation) ist identisch mit der Qualität der Erfahrung. Unterschiedliche Formen entsprechen unterschiedlichen Erfahrungen: Sie fühlen sich so an, wie sie sich anfühlen – rot fühlt sich anders an als blau oder als Kopfschmerzen -, weil ihre Qualia unterschiedliche Formen haben.

Auf dieser Grundlage kann die zentrale Identität des IIT ganz einfach formuliert werden: Eine Erfahrung ist identisch mit einer begrifflichen Struktur, die intrinsisch maximal irreduzibel ist. Genauer gesagt, eine begriffliche Struktur spezifiziert sowohl die Quantität als auch die Qualität der Erfahrung vollständig: Wie sehr das System existiert – die Quantität oder das Niveau des Bewusstseins – wird durch seinen Φmax-Wert – die intrinsische Irreduzibilität der begrifflichen Struktur – gemessen; auf welche Weise es existiert – die Qualität oder der Inhalt des Bewusstseins – wird durch die Form der begrifflichen Struktur spezifiziert. Wenn ein System Φmax = 0 hat, was bedeutet, dass seine Ursache-Wirkungs-Kraft vollständig auf die seiner Teile reduzierbar ist, kann es keinen Anspruch auf Existenz erheben. Wenn Φmax > 0 ist, kann das System nicht auf seine Teile reduziert werden und existiert daher an und für sich. Allgemeiner ausgedrückt: Je größer Φmax, desto mehr kann ein System für sich in Anspruch nehmen, in einem umfassenderen Sinne zu existieren als Systeme mit niedrigerem Φmax. Dem IIT zufolge sind Quantität und Qualität einer Erfahrung eine intrinsische, fundamentale Eigenschaft eines Komplexes von Mechanismen in einem Zustand – die Eigenschaft, den Raum der Möglichkeiten (vergangene und zukünftige Zustände) in einer bestimmten Weise zu informieren oder zu gestalten, so wie es als intrinsisch für eine Masse gilt, die Raumzeit um sie herum zu krümmen.9

Zu jedem beliebigen Zeitpunkt wird das Bewusstsein also durch eine Reihe von neuronalen Elementen unterstützt, die einen Komplex mit hohem Φmax bilden, der eine konzeptuelle Struktur spezifiziert, die intrinsisch maximal irreduzibel ist. Die bestimmte Gruppe von Neuronen, die den Hauptkomplex bilden – derjenige mit dem höchsten Φmax im Gehirn -, kann sich in gewissem Maße von Moment zu Moment ändern, ebenso wie ihr Zustand – welche Neuronen feuern und welche nicht. Nehmen wir zum Beispiel an, dass, während ich mir eine Filmszene mit der Schauspielerin Jennifer Aniston (JA) anschaue, der Hauptkomplex in meinem Gehirn aus Neuronen in bestimmten Teilen der Großhirnrinde besteht.10 Jedes Neuron innerhalb des Komplexes formt notwendigerweise die Wahrscheinlichkeit möglicher vergangener Zustände (Ursachen) und zukünftiger Zustände (Wirkungen) des Komplexes, je nachdem, wie es mit den anderen Neuronen verbunden ist und in welchem Zustand es sich befindet (z. B. stark feuernd für 100 ms). So kann ein Neuron, das in einem bestimmten visuellen Bereich stark feuert, diejenigen vergangenen Zustände des Komplexes als wahrscheinlicher bezeichnen, die mit dem invarianten Konzept „J.A.s Gesicht“ vereinbar sind, sowie bestimmte geeignete zukünftige Zustände. Ein anderes Neuron, das in einem anderen visuellen Bereich stark feuert, kann angeben, dass es an einer bestimmten Stelle des Gesichtsfeldes wahrscheinlich eine horizontale Kante gab, und so weiter. Andere Neuronen, die Teil des Komplexes sind, aber schweigen, können angeben, dass es unwahrscheinlich ist, dass bestimmte vergangene (und zukünftige) Zustände eingetreten sind (oder eintreten werden), z. B. solche, die mit den unveränderlichen Konzepten „Buch“, „Quadrat“ usw. zu tun haben. Darüber hinaus können Kombinationen von Neuronen Konzepte höherer Ordnung spezifizieren, wie z.B. „J.A. mit einem roten Hut sitzt auf der Couch links“. Man beachte, dass alle Konzepte durch Elemente des Komplexes spezifiziert werden, Ursache-Wirkungs-Repertoires über Elemente des Komplexes spezifizieren und Bedeutung intrinsisch, in Bezug auf die anderen Konzepte in der Quale, und nicht durch Bezugnahme auf externe Inputs erlangen (J.A. ist genauso bedeutungsvoll, wenn ich von ihr tagträume oder träume) [80].

Im Prinzip bieten die Postulate der IIT also eine Möglichkeit, ein beliebiges System von Mechanismen in einem bestimmten Zustand zu analysieren und zu bestimmen, ob es einen Komplex darstellt, über welches räumliche und zeitliche Korn11 und welche Quale es spezifiziert. Auch wenn es in der Praxis nicht möglich ist, die Quale und Φmax für ein realistisches System genau zu bestimmen, ist es bereits möglich, die IIT für Vorhersagen, Erklärungen und Extrapolationen einzusetzen.

(d) Vorhersagen

Eine einfache experimentelle Vorhersage der IIT ist, dass der Verlust und die Wiedererlangung des Bewusstseins mit dem Zusammenbruch und der Wiedererlangung der Fähigkeit des Gehirns zur Informationsintegration verbunden sein sollte. Diese Vorhersage wurde durch die transkranielle Magnetstimulation (TMS) in Kombination mit einem hochdichten EEG unter Bedingungen bestätigt, die durch Bewusstseinsverlust gekennzeichnet sind [95,96]. Dazu gehören Tiefschlaf, Vollnarkose mit verschiedenen Wirkstoffen und hirngeschädigte Patienten (vegetativ, bei minimalem Bewusstsein, aus minimalem Bewusstsein kommend, Locked-in). Ist eine Versuchsperson bei Bewusstsein, wenn die Großhirnrinde mit einem von der TMS-Spule induzierten Stromimpuls von der Schädelaußenseite her sondiert wird, antwortet die Rinde mit einem komplexen Muster von nachhallenden Aktivierungen und Deaktivierungen, das sowohl weit verbreitet (integriert) als auch zeitlich und räumlich differenziert (informationsreich) ist [95]. Im Gegensatz dazu wird die Reaktion des Kortex lokal (Verlust der Integration) oder global, aber stereotyp (Verlust von Informationen), wenn das Bewusstsein schwindet. Der Perturbationskomplexitätsindex (PCI), ein skalares Maß für die Komprimierbarkeit der EEG-Antwort auf TMS in Anlehnung an die IIT, nimmt unter allen verschiedenen Bedingungen des Bewusstseinsverlusts deutlich ab und ist, was für ein klinisch nützliches Gerät entscheidend ist, stattdessen bei allen bisher getesteten bewussten gesunden Probanden oder neurologischen Patienten hoch [96].

Eine Theorie ist umso mächtiger, je mehr sie korrekte Vorhersagen macht, die gegen frühere Erwartungen verstoßen. Eine kontraintuitive Vorhersage der IIT ist, dass ein System wie die Großhirnrinde auch dann Erfahrungen erzeugen kann, wenn die Mehrheit ihrer Pyramidenneuronen nahezu stumm ist – ein Zustand, der vielleicht durch bestimmte meditative Praktiken angenähert wird, die darauf abzielen, ein „nacktes“ Bewusstsein ohne Inhalt zu erreichen [97,98]. Diese Konsequenz der IIT steht im Gegensatz zu der weit verbreiteten Annahme, dass Neuronen nur dann zum Bewusstsein beitragen, wenn sie so aktiv sind, dass sie die Informationen, die sie repräsentieren, „signalisieren“ oder „senden“ und die fronto-parietalen Netzwerke „entzünden“ [3]. Dass stille Neuronen zum Bewusstsein beitragen können, liegt daran, dass in der IIT die Information nicht in der Nachricht besteht, die von einem Element gesendet wird, sondern in Form der konzeptuellen Struktur, die durch einen Komplex spezifiziert wird. Inaktive Elemente eines Komplexes spezifizieren ein Ursache-Wirkungs-Repertoire (die Wahrscheinlichkeit möglicher vergangener und zukünftiger Zustände) ebenso wie aktive (man denke an den Hund, der in der berühmten Sherlock-Holmes-Geschichte nicht bellt). Umgekehrt würden dieselben Neuronen, wenn sie nicht nur inaktiv wären, sondern pharmakologisch oder optogenetisch inaktiviert würden, nicht mehr zum Bewusstsein beitragen: Auch wenn ihr tatsächlicher Zustand derselbe ist, würden sie kein Ursache-Wirkungs-Repertoire spezifizieren, da sie die Wahrscheinlichkeit möglicher vergangener und zukünftiger Zustände des Komplexes nicht beeinflussen.12

Eine weitere kontraintuitive Vorhersage des IIT ist, dass, wenn die Wirksamkeit der 200 Millionen Kallosalfasern, über die die beiden Gehirnhälften miteinander kommunizieren, schrittweise reduziert würde, es einen Moment geben würde, in dem es bei einer minimalen Veränderung des Verkehrs neuronaler Impulse über das Callosum zu einer Alles-oder-Nichts-Veränderung des Bewusstseins käme: Die Erfahrung würde von einer einzigen zu einer plötzlichen Aufspaltung in zwei getrennte erlebende Bewusstseine (von denen eines sprachlich dominiert) übergehen, wie wir es von Split-Brain-Patienten kennen [101,102]. Dies wäre der Punkt, an dem Φmax für das gesamte Gehirn unter den Wert von Φmax für die linke und für die rechte Hemisphäre für sich genommen fallen würde.

Allgemeiner ausgedrückt, sagt die IIT voraus, dass das neuronale Korrelat des Bewusstseins (NCC) – unabhängig davon, ob es global oder lokal im Kortex, anterior oder posterior, medial oder lateral ist, ob es primäre Bereiche oder den Thalamus einschließt oder nicht, ob es Neuronen in supragranulären oder infragranulären Schichten des Kortex umfasst oder nicht – ein lokales Maximum von Φ und damit ein Maximum an intrinsischer, irreduzibler Ursache-Wirkungs-Kraft sein sollte. IIT sagt auch voraus, dass das NCC nicht notwendigerweise fest ist, sondern sich ausdehnen, schrumpfen und sogar innerhalb eines bestimmten Gehirns verschieben kann, je nach den verschiedenen Bedingungen. Es kann sogar mehrere NCCs in einem einzigen Gehirn geben, wie dies bei Split-Brain-Patienten der Fall ist, bei denen es mehrere lokale Maxima der integrierten Information geben sollte. Schließlich macht die IIT genaue Vorhersagen über die physikalischen Elemente, die das NCC bilden, sowie über die Zeitintervalle und Aktivitätsniveaus, in denen sie arbeiten [77,79]: Sie sollten einen räumlichen Maßstab haben, der den höchsten Wert von Φ erreicht, im Gegensatz zu feineren oder gröberen Körnern (z. B. entweder einzelne Neuronen oder lokale Gruppen von Neuronen statt neuronaler Kompartimente oder Hirnbereiche); sie sollten am effektivsten (höchster Wert von Φ) auf der Zeitskala des Bewusstseins arbeiten, im Gegensatz zu feineren oder gröberen Skalen (z. B. hundert Millisekunden statt einer Millisekunde oder zehn Sekunden); und die Aktivitätszustände, die den größten Unterschied für das NCC machen, sollten diejenigen sein, die phänomenologische Unterscheidungen unterstützen (z. B. Bursting, hohes mittleres Feuern, niedriges mittleres Feuern). Kurz gesagt, die allgemeine Regel lautet, dass das NCC immer einem Maximum an intrinsischer, nicht reduzierbarer Ursache-Wirkung-Leistung entsprechen muss.

(e) Erklärungen

Die IIT bietet eine kohärente, prinzipielle Erklärung für das NCC – das sie mit dem Hauptkomplex in einem bestimmten Zustand identifiziert – und für viele disparate empirische Beobachtungen. Warum zum Beispiel wird das Bewusstsein von der Großhirnrinde (oder zumindest von Teilen davon) erzeugt, während das Kleinhirn keinen Beitrag dazu leistet, obwohl letzteres über noch mehr Neuronen verfügt [103]? Warum schwindet das Bewusstsein schon früh im Schlaf, obwohl das Gehirn aktiv bleibt? Warum geht es während generalisierter Krampfanfälle verloren, wenn die neuronale Aktivität intensiv und synchron ist? Warum gibt es keinen direkten Beitrag zum Bewusstsein von neuronaler Aktivität in den sensorischen Bahnen (der Netzhaut) und den motorischen Bahnen (den Motoneuronen im Rückenmark) oder in den neuronalen Schaltkreisen, die aus dem Kortex in subkortikale Strukturen und zurück verlaufen, obwohl sie offensichtlich in der Lage sind, den Inhalt der Erfahrung zu beeinflussen?

Diese und andere bekannte Tatsachen finden auf der Grundlage der Postulate des IIT eine schlüssige Erklärung. So ist ein herausragendes Merkmal der Großhirnrinde, die für den Inhalt des Bewusstseins verantwortlich ist, dass sie aus Elementen besteht, die funktionell spezialisiert sind und gleichzeitig schnell und effektiv interagieren können. Dies ist die Art von Organisation, die einen vergleichsweise hohen Φmax-Wert ergibt. Stattdessen besteht das Kleinhirn aus kleinen Modulen, die Inputs verarbeiten und Outputs weitgehend unabhängig voneinander produzieren [104,105]. Simulationen zeigen auch, dass Eingangs- und Ausgangsbahnen zwar in der Lage sind, den Hauptkomplex zu beeinflussen und von ihm beeinflusst zu werden, aber von ihm ausgeschlossen bleiben können, weil sie nicht Teil eines lokalen Maximums integrierter Informationen sind. Das Gleiche gilt für Schleifen, die den Hauptkomplex verlassen und wieder in ihn eintreten können. Andere Simulationen zeigen, dass Φmax niedrig ist, wenn die effektive Konnektivität zwischen einer Reihe von Elementen schwach ist oder in homogener Weise organisiert ist. Wie bereits erwähnt, werden die Interaktionen zwischen verschiedenen kortikalen Regionen schwächer oder sehr stereotyp, wenn das Bewusstsein während des Tiefschlafs mit langsamen Wellen oder in bestimmten Zuständen der allgemeinen Anästhesie schwindet, wie es bei generalisierten epileptischen Anfällen der Fall ist.

(f) Hochrechnungen

Je mehr die Postulate der IIT in Situationen validiert werden, in denen wir einigermaßen sicher sind, ob und wie sich das Bewusstsein verändert, desto mehr können wir die Theorie nutzen, um zu extrapolieren und Rückschlüsse auf Situationen zu ziehen, in denen wir weniger sicher sind – hirngeschädigte Patienten, neugeborene Babys, fremdartige Tiere, komplizierte Maschinen und andere weit hergeholte Szenarien, wie wir im Folgenden betrachten werden.

5. Überall?

Im „Gesang der Kreaturen“ spricht Franziskus Tiere, Blumen und sogar Steine an, als wären sie beseelt, und preist sie als Mutter Erde, Bruder Sonne, Schwester Mond, die Sterne, die Luft, das Wasser und das Feuer. Und er war nicht allein. Einige der klügsten Köpfe des Westens vertraten eine Form der antiken philosophischen Lehre des Panpsychismus, angefangen bei den Vorsokratikern und Platon. Die Renaissance-Philosophen Patrizi, Bruno, Telesio und Campanella vertraten den Standpunkt, dass Materie und Seele eine einzige Substanz sind. Später vertraten Spinoza, Leibniz, Schopenhauer und, näher an der Neuzeit, James, Whitehead, Russell und Teilhard de Chardin panpsychistische Vorstellungen [106,107]. Strawson [108,109] ist ein bekannter zeitgenössischer Verfechter des Panpsychismus. Östliche Traditionen wie der Buddhismus haben stets die Kontinuität des Bewusstseins über das gesamte Leben hinweg betont.

Der Materialismus bzw. sein moderner Abkömmling, der Physikalismus, hat von Galileis pragmatischer Haltung, die Subjektivität (den Geist) aus der Natur zu entfernen, um sie objektiv zu beschreiben und zu verstehen – aus der extrinsischen Perspektive eines Manipulators/Beobachters -, immens profitiert. Dies geschah jedoch um den Preis, dass der zentrale Aspekt der Realität aus der intrinsischen Perspektive – die Erfahrung selbst – ignoriert wurde. Im Gegensatz zum Idealismus, der die physische Welt abschafft, oder zum Dualismus, der beide in einer unbehaglichen Ehe akzeptiert, ist der Panpsychismus auf elegante Weise einheitlich: Es gibt nur eine Substanz, von den kleinsten Entitäten bis hin zum menschlichen Bewusstsein und vielleicht zur Weltseele (anima mundi). Aber die Schönheit des Panpsychismus ist auf einzigartige Weise unfruchtbar. Außer der Behauptung, dass Materie und Geist eins sind, hat er wenig Konstruktives zu sagen und bietet keine positiven Gesetze, die erklären, wie der Geist organisiert ist und funktioniert.

IIT wurde nicht mit Blick auf den Panpsychismus entwickelt. In Übereinstimmung mit den zentralen Intuitionen des Panpsychismus behandelt die IIT jedoch das Bewusstsein als eine intrinsische, grundlegende Eigenschaft der Realität. IIT impliziert auch, dass das Bewusstsein abgestuft ist, dass es wahrscheinlich unter den Tieren weit verbreitet ist und dass es in kleinen Mengen sogar in bestimmten einfachen Systemen gefunden werden kann. Im Gegensatz zum Panpsychismus impliziert die IIT jedoch eindeutig, dass nicht alles bewusst ist. Darüber hinaus bietet die IIT eine Lösung für mehrere der konzeptionellen Hindernisse, die die Panpsychisten nie richtig gelöst haben, wie das Problem der Aggregate (oder das Kombinationsproblem [107,110]), und kann seine Qualität erklären. Sie erklärt auch, warum das Bewusstsein anpassungsfähig sein kann, und legt damit einen Grund für seine Evolution nahe.

(a) Das Bewusstsein ist eine grundlegende Eigenschaft

Die Axiome und Postulate der IIT besagen, dass das Bewusstsein eine fundamentale, beobachterunabhängige Eigenschaft ist, die durch die intrinsische Ursache-Wirkungs-Kraft bestimmter Mechanismen in einem Zustand erklärt werden kann – wie sie dem Raum der Möglichkeiten in ihrer Vergangenheit und ihrer Zukunft Form geben. Eine Analogie dazu ist die Masse, die dadurch definiert werden kann, wie sie die Raumzeit um sich herum krümmt – nur dass im Fall der Erfahrung die Entitäten, die diese Eigenschaft haben, keine Elementarteilchen sind, sondern Komplexe von Elementen, und Erfahrung gibt es nicht in zwei, sondern in einer Billion Varianten. Zumindest in diesem allgemeinen Sinne steht die IIT nicht im Widerspruch zum Panpsychismus.

(b) Das Bewusstsein hat verschiedene Qualitäten

Leider ist der Panpsychismus stumm, wenn es darum geht, die Art und Weise zu erklären, wie sich eine bestimmte bewusste Erfahrung anfühlt – warum sich die Wahrnehmung von Rot anders anfühlt als die von Blau und warum Farben anders erlebt werden als Töne. Stattdessen sagt die IIT zumindest im Prinzip genau, was die Qualität einer Erfahrung bestimmt – was sie zu dem macht, was sie ist: Eine Erfahrung ist eine maximal irreduzible konzeptuelle Struktur oder Qualität – eine Form in einem fantastisch hochdimensionalen Ursache-Wirkungs-Raum, die durch einen Komplex von Neuronen in einem bestimmten Zustand spezifiziert wird. Dies ist die Konstellation von Konzepten, durch die die Neuronen des Hauptkomplexes in verschiedenen Kombinationen dem Raum seiner möglichen vergangenen und zukünftigen Zustände Form geben (Abbildung 4). Verschiedene Erfahrungen – jede verschiedene Szene in einem Film oder in einem Traum – entsprechen verschiedenen Formen, wobei einige Formen messbar näher (rot und blau) und andere weiter entfernt im Raum liegen (eine schwarze Leinwand und eine Stadtszene). In der Tat gibt es viel Spielraum für künftige Forschungen, um die Psychophysik, z. B. die kreisförmige Natur des Farbraums, auf die Geometrie von Formen im Ursache-Wirkungs-Raum abzubilden – wobei eine Form im Ursache-Wirkungs-Raum, anders als die Form eines Objekts im 3D-Raum, die Form im Inneren ist, die Form der Erfahrung selbst. Es ist die Stimme im Kopf, das Licht im Schädel.

(c) Das Bewusstsein ist anpassungsfähig

Die IIT nimmt keine Stellung zur Funktion der Erfahrung als solcher – ähnlich wie die Physik nichts über die Funktion von Masse oder Ladung zu sagen hat. Durch die Identifizierung des Bewusstseins mit integrierter Information kann die IIT jedoch erklären, warum es sich entwickelt hat – ein weiterer Aspekt, zu dem der Panpsychismus nichts zu sagen hat. Im Allgemeinen passt ein Gehirn mit einer hohen Kapazität zur Informationsintegration besser zu einer Umgebung mit einer komplexen kausalen Struktur, die sich über mehrere Zeitskalen erstreckt, als ein Netzwerk, das aus vielen Modulen besteht, die informationell gekapselt sind. Tatsächlich zeigen künstliche Lebenssimulationen („Animats“) von einfachen Braitenberg-ähnlichen Vehikeln, die Labyrinthe durchqueren müssen und deren Gehirne sich durch natürliche Selektion über 60.000 Generationen entwickeln, eine monotone Beziehung zwischen (simulierter) integrierter Information und Anpassung [111,112]. Das heißt, je besser die einzelnen Animats an ihre Umwelt angepasst sind, desto höher ist die integrierte Information des Hauptkomplexes in ihrem Gehirn. Ähnliche Animats, die entwickelt wurden, um fallende Blöcke in einem Tetris-ähnlichen Szenario aufzufangen, zeigen, dass eine erhöhte Anpassung zu einer größeren Anzahl von Konzepten im Hauptkomplex und einer damit verbundenen Zunahme der integrierten Information führt, die von der Komplexität der Umgebung der Animats abhängt [113]. So führt die Evolution durch natürliche Selektion zu Organismen mit hohem Φmax, weil sie angesichts der Beschränkungen für die Anzahl der Elemente und Verbindungen mehr Funktionen pro Element unterbringen können als ihre weniger integrierten Konkurrenten und somit geschickter darin sind, Regelmäßigkeiten in einer reichhaltigen Umgebung auszunutzen.

(d) Das Bewusstsein ist abgestuft

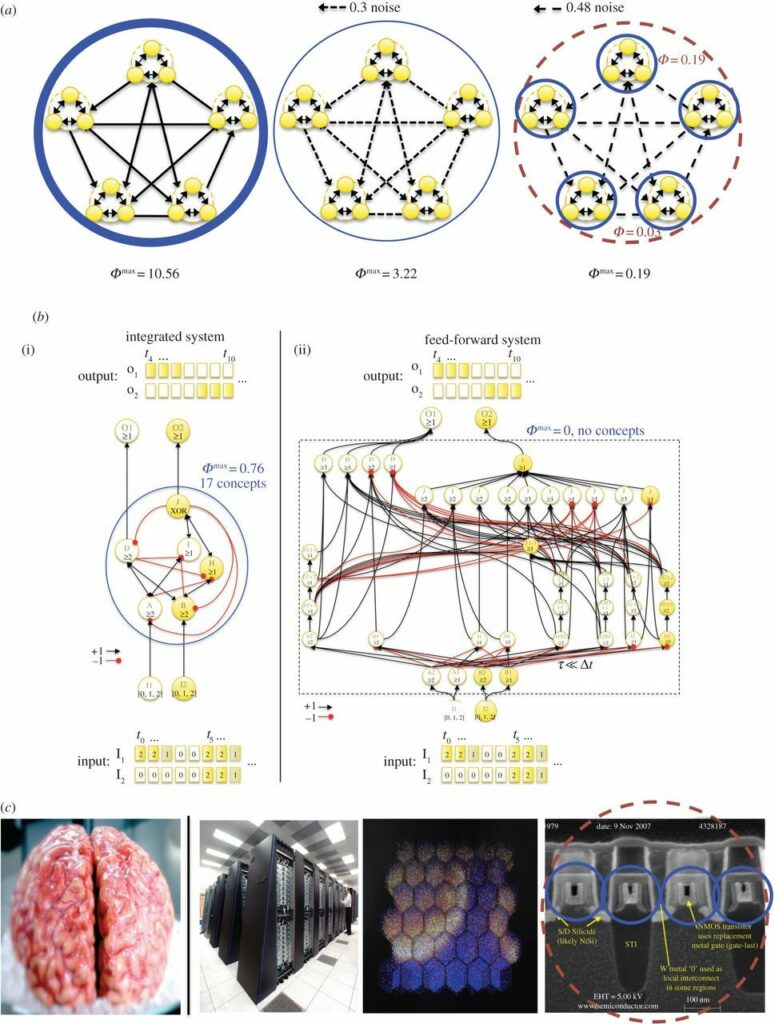

Die IIT schließt sich der panpsychistischen Intuition an, dass das Bewusstsein im gesamten Tierreich und sogar darüber hinaus vorhanden sein könnte, wenn auch in unterschiedlichem Maße. Wenn alles andere gleich bleibt, wird die integrierte Information und damit der Reichtum der Erfahrung wahrscheinlich mit der Anzahl der Neuronen und der Fülle ihrer Verbindungen zunehmen, obwohl die schiere Anzahl der Neuronen keine Garantie ist, wie das Kleinhirn zeigt. Es ist auch wahrscheinlich, dass das Bewusstsein im Laufe des Lebens eines Organismus abgestuft ist. Bei uns wird es reicher, wenn wir vom Baby zum Erwachsenen heranwachsen, dessen Gehirn voll ausgereift ist und sich funktionell stärker spezialisiert. Es kann auch zu- und abnehmen, wenn wir sehr wach oder schläfrig sind, von Drogen oder Alkohol berauscht sind oder im Alter dement werden. Dies wird in Abbildung 5a schematisch veranschaulicht, wo eine Reihe von „kortikalen“ Bereichen in einen großen Komplex mit „hoher“ Φmax integriert ist, wenn die Verbindungen zwischen den Arealen stark sind, hingegen eine Verringerung der Φmax erfährt, wenn die Verbindungsstärke durch neuromodulatorische Veränderungen (simuliert als Zunahme des Rauschens) verringert wird, und schließlich in kleine Komplexe mit niedriger Φmax zerfällt.

Abbildung 5. IIT macht mehrere Vorhersagen darüber, welche Systeme etwas erfahren können – wie viel und auf welche Weise – und welche Systeme, selbst komplizierte, keine Erfahrung haben und „im Dunkeln“ bleiben. IIT impliziert, dass das Bewusstsein abgestuft ist (a); dass Aggregate kein Bewusstsein haben (a, rechtes Feld); dass Systeme mit strikter Vorwärtskopplung kein Bewusstsein haben (b, rechtes Feld), selbst wenn sie funktionell äquivalent sind in Bezug auf ihre Input-Output-Operationen zu Netzwerken mit Rückkopplung, die Bewusstsein haben (b, linkes Feld); dass selbst genaue biophysikalische Simulationen des menschlichen Gehirns, die auf digitalen Maschinen laufen, kein Bewusstsein hätten wie wir, sondern lediglich Aggregate von viel einfacheren Systemen (Transistoren und dergleichen) mit minimalem Φmax wären (c). Die letzte Reihe (c) zeigt von links nach rechts ein menschliches Gehirn (Allen Institute), den IBM Blue Gene P Supercomputer, ein säulenförmiges Modell des Mäusekortex (Blue Brain Project) und einen rasterelektronenmikroskopischen Querschnitt von 4 NMOS INTEL-Transistoren in einem Gitter.

Eine Konsequenz der IIT, die gegen gängige Intuitionen verstößt, ist, dass selbst so einfache Schaltungen wie eine „Fotodiode“, die aus einem Sensor und einem Speicherelement besteht, ein gewisses Maß an Erfahrung haben können [80] (siehe auch Abbildung 5a, rechtes Feld). Es ist fast unmöglich, sich vorzustellen, wie es sich anfühlen würde, ein solcher Schaltkreis zu sein, für den die einzige phänomenale Unterscheidung zwischen „dies und nicht dies“ wäre (im Gegensatz zu einer Photodiode ist unsere Erfahrung, wenn wir uns des „Lichts“ oder der „Dunkelheit“ bewusst sind, das, was sie ist, weil sie eine Menge negativer Konzepte enthält, wie keine Farben, keine Formen, keine Gedanken und so weiter, die uns alle zur Verfügung stehen). Aber bedenken Sie, dass normale Materie bei -272,15 °C, also ein Grad über dem absoluten Nullpunkt, noch etwas Wärme enthält. In der Praxis ist diese Temperatur jedoch so kalt wie nur möglich. In ähnlicher Weise mag es einen praktischen Schwellenwert für Φmax geben, unterhalb dessen die Menschen nicht mehr viel fühlen, aber das bedeutet nicht, dass das Bewusstsein sein absolutes Minimum, den Nullpunkt, erreicht hat. Wenn wir in einen tiefen, traumlosen Schlaf fallen und nach dem Aufwachen über keinerlei Erfahrungen berichten, hat ein kleiner Komplex von Neuronen in unserem schlafenden Gehirn wahrscheinlich einen Φmax-Wert, der größer als Null ist, was jedoch im Vergleich zu unserer reichen, alltäglichen Erfahrung nicht viel ausmacht.

(e) Mehrere Bewusstseine

IIT lässt auch die Möglichkeit zu, dass zwei oder mehr Komplexe innerhalb eines einzigen Systems koexistieren [80]. Je nach der genauen Konnektivität werden diese wahrscheinlich ganz unterschiedliche Φmax-Werte haben. In den Gehirnen sowohl von Wirbeltieren als auch von wirbellosen Tieren kann es, zumindest unter bestimmten Bedingungen, durchaus einen Hauptkomplex und einen oder mehrere Nebenkomplexe geben. Beim Menschen sollte der Komplex, der unseren täglichen Strom bewusster Erfahrung unterstützt, bei weitem den höchsten Wert integrierter Informationen haben – es sollte der Hauptkomplex sein. Bei Patienten mit gespaltenem Gehirn weiß der sprechende Hauptkomplex nichts vom Vorhandensein eines anderen Bewusstseins – eines Bewusstseins, das typischerweise nicht spricht, das aber durch geschickte experimentelle Paradigmen aufgedeckt werden kann [102,114]. Es ist denkbar, dass zumindest einige Fälle von Leistungen auf „hohem Niveau“, die bei normalen Probanden zu beobachten sind [64,115]), aus der Perspektive des Hauptkomplexes unbewusst sind, aber auf das Vorhandensein von Nebenkomplexen zurückzuführen sind (natürlich können einige dieser Verhaltensweisen durch reine Feedforward-Schaltkreise vermittelt werden). Dieses kontraintuitive Szenario von „vielen bewussten Köpfen in einem einzigen Gehirn“ könnte zumindest im Prinzip durch Messungen der integrierten Informationen auf neuronaler Ebene bewertet werden. Major- und Minor-Komplexe können auch bei Patienten mit der Marchiafava-Bignami-Krankheit [116] und anderen Diskonnexionssyndromen, bei Patienten mit Identitäts- und Konversionsstörungen [63] sowie bei anderen neurologischen und psychiatrischen Erkrankungen auftreten.

(f) Aggregate sind nicht bewusst

„Man nehme einen Satz mit einem Dutzend Wörtern, nehme zwölf Männer und sage jedem ein Wort. Dann stelle man die Männer in eine Reihe oder schiebe sie in einen Haufen und lasse jeden so intensiv an sein Wort denken, wie er will; nirgends wird es ein Bewusstsein für den ganzen Satz geben“. So illustrierte William James das Kombinationsproblem des Panpsychismus [110]. Oder nehmen wir John Searle: „Das Bewusstsein kann sich nicht wie eine dünne Schicht Marmelade über das Universum ausbreiten; es muss einen Punkt geben, an dem mein Bewusstsein endet und Ihres beginnt“ [117]. Wenn das Bewusstsein überall ist, warum sollte es dann nicht auch die Vereinigten Staaten von Amerika beseelen? Die IIT geht dieses Problem direkt an, indem sie behauptet, dass es nur Maxima integrierter Information gibt. Nehmen wir an, zwei Menschen sprechen miteinander: In jedem Gehirn gibt es einen Hauptkomplex – eine Menge von Neuronen, die eine maximal irreduzible Ursache-Wirkungs-Struktur mit eindeutigen Grenzen und einem hohen Wert von Φmax bilden. Lassen Sie die beiden nun miteinander sprechen. Sie werden nun ein System bilden, das aufgrund ihrer Wechselwirkungen ebenfalls irreduzibel ist (Φ > Null). Es ist jedoch nicht maximal irreduzibel, da sein Wert an integrierter Information viel geringer sein wird als der jedes der beiden Hauptkomplexe, die es enthält. Der IIT zufolge sollte es tatsächlich zwei getrennte Erfahrungen geben, aber keine übergeordnete bewusste Einheit, die die Vereinigung der beiden darstellt. Mit anderen Worten: Es gibt nicht zwei Menschen, geschweige denn die mehr als 300 Millionen Bürger, aus denen die USA bestehen.13 Auch dieser Punkt lässt sich anhand des Systems in Abbildung 5a, rechtes Feld, schematisch verdeutlichen. Während die fünf kleinen Komplexe interagieren und ein größeres integriertes System bilden, ist das größere System kein Komplex: Nach dem Ausschlusspostulat existieren nur die fünf kleineren Komplexe, da sie lokale Maxima der integrierten Information sind (Φmax = 0,19), während das größere System kein Komplex ist (Φ = 0,03). Schlimmer noch, ein dummes Ding mit kaum unterscheidbaren Zuständen, sagen wir mal ein Sandkorn, hat keinerlei Erfahrung. Und wenn man eine große Anzahl solcher Null-Φ-Systeme übereinander stapelt, würde sich ihr Φ nicht auf einen Wert ungleich Null erhöhen: Eine Sanddüne zu sein, fühlt sich auch nicht wie etwas an – Aggregate haben kein Bewusstsein.

(g) Komplizierte Systeme können unbewusst sein

Eine zweite Klasse von Null-Φ-Systemen sind reine Feedforward-Rechnernetze, bei denen eine Schicht die nächste ohne rekurrente Verbindungen speist. In einem Feed-Forward-Netz wird die Eingabeschicht immer vollständig durch externe Eingaben bestimmt, und die Ausgabeschicht wirkt sich nicht auf den Rest des Systems aus, so dass keine der beiden Schichten Teil eines Komplexes sein kann, und das Gleiche gilt rekursiv für die nächsthöheren und nächstniedrigeren Schichten. Der IIT zufolge existiert ein Feed-Forward-Netzwerk also nicht an sich, sondern ist ein Zombie, der unbewusst Aufgaben ausführt [118]. Doch aus der extrinsischen Perspektive eines Nutzers führen Feed-Forward-Netzwerke, wie sie beim Deep Learning verwendet werden, viele nützliche Rechenfunktionen aus, wie das Auffinden von Gesichtern oder Katzen in Bildern [119], das Etikettieren von Bildern, das Lesen von Postleitzahlen und das Aufspüren von Kreditkartenbetrug.

Dies hat eine ziemlich verblüffende Konsequenz. Man bedenke, dass jedes neuronale Netz mit Rückkopplungsschaltungen so auf ein reines Feed-Forward-Netz abgebildet werden kann, dass letzteres seine Input-Output-Beziehungen annähert (für Berechnungen, die durch einen maximalen Zeitschritt begrenzt sind [120]). Das heißt, dass die beiden Netze bei gleichen Eingaben die gleiche Ausgabe liefern (im Allgemeinen hat das äquivalente Feedforward-Netz viel mehr Knoten und Verbindungen als das Feedback-Netz). Daher wäre ein reines Feed-Forward-System, das in der Lage ist, das Input-Output-Verhalten des menschlichen Gehirns (unter der Einschränkung eines begrenzten Zeitschritts) zu replizieren, in seinem Verhalten nicht von uns zu unterscheiden und sicherlich in der Lage, den Turing-Test zu bestehen, doch hätte es ein Φ von Null und wäre somit ein „perfekter“ Zombie. Ein einfaches Beispiel für zwei funktional äquivalente Systeme, eines mit rekurrenten Verbindungen und einem Φ ungleich Null und eines mit reiner Vorwärtskopplung und einem Φ gleich Null, ist in Abbildung 5b [80] dargestellt.

Bei Menschen und Organismen, die sich durch natürliche Selektion entwickelt haben, liefert das Input-Output-Verhalten einen guten ersten Hinweis auf das Vorhandensein von Bewusstsein. Wie das Beispiel in Abbildung 5b zeigt, ist dies jedoch nicht immer der Fall, wenn es sich um radikal unterschiedliche Rechnerarchitekturen handelt. Im allgemeinen Fall, und sicherlich bei Maschinen, ist es unerlässlich, die internen Schaltkreise zu betrachten – nicht nur was die Maschine tut, sondern auch wie sie es tut. Das bedeutet auch, dass es keinen ultimativen Turing-Test für das Bewusstsein geben kann (obwohl es einige praktische CAPTCHA-ähnliche Tests geben könnte [121]). Nach vielen funktionalistischen Auffassungen [122] müsste einer Maschine, die unser Input-Output-Verhalten unter allen Umständen reproduziert, genauso viel Bewusstsein zugestanden werden wie uns. Die IIT ist da ganz anderer Meinung – kein Turing-Test (z. B. Samantha in dem Hollywood-Film „She“) kann ein hinreichendes Kriterium für Bewusstsein sein, ob menschlich oder nicht.

(h) Simulationen von bewussten neuronalen Systemen können unbewusst sein

Wie wäre es schließlich mit einem Computer, dessen Software nicht nur unser Verhalten, sondern sogar die Biophysik der Neuronen, Synapsen usw. des entsprechenden Teils des menschlichen Gehirns im Detail simuliert [123]? Könnte ein solches digitales Simulakrum jemals ein Bewusstsein haben? Der Funktionalismus würde dies bejahen, wenn auch mit mehr Nachdruck. Denn in diesem Fall wären alle relevanten Funktionsrollen innerhalb unseres Gehirns, nicht nur unser Input-Output-Verhalten, originalgetreu nachgebildet worden. Warum sollten wir diesem Simulakrum nicht dasselbe Bewusstsein zugestehen, das wir einem Mitmenschen zugestehen? Nach Ansicht der IIT wäre dies jedoch nicht gerechtfertigt, und zwar aus dem einfachen Grund, dass das Gehirn real ist, die Simulation eines Gehirns jedoch virtuell ist. Für die IIT ist das Bewusstsein eine grundlegende Eigenschaft bestimmter physikalischer Systeme, die eine reale Ursache-Wirkungs-Macht voraussetzt, insbesondere die Macht, den Raum möglicher vergangener und zukünftiger Zustände in einer Weise zu gestalten, die intrinsisch maximal irreduzibel ist. In gleicher Weise ist die Masse eine intrinsische Eigenschaft von Teilchensystemen, eine Eigenschaft, die echte kausale Macht hat, insbesondere die Macht, die Raumzeit zu krümmen. So wie eine Computersimulation eines riesigen Sterns die Raumzeit um die Maschine herum nicht krümmt, wird eine Simulation unseres bewussten Gehirns kein Bewusstsein haben.14 Natürlich ist der physikalische Computer, auf dem die Simulation läuft, genauso real wie das Gehirn. Nach den Grundsätzen der IIT sollte man jedoch seine realen physikalischen Komponenten analysieren – Elemente, z. B. Transistoren, identifizieren, ihr Ursache-Wirkungs-Repertoire definieren, Konzepte und Komplexe finden und die räumlich-zeitliche Skala bestimmen, bei der Φ ein Maximum erreicht. In diesem Fall vermuten wir, dass der Computer wahrscheinlich nicht einen großen Komplex mit hohem Φmax bilden würde, sondern in viele Minikomplexe mit niedrigem Φmax zerfällt. Dies ist auf das geringe Ein- und Ausfächern der digitalen Schaltkreise zurückzuführen (Abbildung 5c), was wahrscheinlich zu einer maximalen Ursache-Wirkungs-Leistung auf der schnellen zeitlichen Skala der Computeruhr führt.15

6. Schlussfolgerungen

Zusammenfassend lässt sich sagen, dass es einige Aspekte der IIT gibt, die definitiv nicht zum Panpsychismus passen, und andere, die einige seiner Intuitionen rechtfertigen. In dieser Hinsicht ist es nur natürlich, darüber nachzudenken, wie man einige der aus der IIT abgeleiteten Schlussfolgerungen betrachten sollte, für die man sich zum jetzigen Zeitpunkt nicht einmal einen direkten Test vorstellen kann. Wir vertreten den Standpunkt, dass eine Theorie, wie es in der Wissenschaft häufig der Fall ist16, zunächst in Situationen getestet und validiert wird, die dem Ideal nahe kommen, und dann auf weiter entfernte Fälle extrapoliert wird. Idealerweise würden die Frage, ob das Bewusstsein mit der integrierten Information variiert, und andere Vorhersagen der IIT zunächst an meinem eigenen Bewusstsein validiert: Bricht Φmax beispielsweise zusammen, wenn ich mich einer Vollnarkose unterliege oder einen Krampfanfall habe oder wenn ich in einen traumlosen Schlaf falle, und kehrt zu hohen Werten zurück, wenn ich träume? Ändert sich mein Erleben, wenn man eine zum Hauptkomplex gehörende Hirnregion vorübergehend inaktiviert, aber nicht eine, die außerhalb liegt? Ändert es sich, wenn es gelingt, einen neuromorphen Mikroschaltkreis zu verbinden, der Teil meines Hauptkomplexes wird und nicht ein anderer? Dann kann man von dort aus extrapolieren, zunächst in Situationen mit anderen gesunden Menschen, dann in etwas schwierigeren Fällen, z. B. bei Affen mit einem ähnlichen Gehirn wie dem unseren, die darauf trainiert werden, ähnliche Berichte wie wir zu geben. Schließlich kann man, sofern die Theorie validiert ist und eine gute Vorhersage- und Erklärungskraft aufweist, versuchen, sie auf alle Bereiche zu übertragen, auf nicht ansprechbare Patienten mit nur einer kleinen „Insel“ funktionierenden Hirngewebes, auf Neugeborene, auf Tiere, die sich stark von uns unterscheiden, auf Photodioden, Maschinen und Computersimulationen. Schließlich können wir in der Wissenschaft oft nur unsere besten Schlüsse über unbekannte Fälle auf der Grundlage einer Theorie ziehen, die in vielen bekannten Fällen gut funktioniert. Und das ist viel besser, als willkürliche Behauptungen aufzustellen oder überhaupt keine Schlüsse zu ziehen.

Danksagungen

Wir danken Larissa Albantakis, Melanie Boly, Chiara Cirelli, Lice Ghilardi und Marcello Massimini für ihre zahlreichen Beiträge zu der hier vorgestellten Arbeit.

Fußnoten

1 Wir betrachten das reflektierende Bewusstsein, das bei erwachsenen Menschen hoch entwickelt ist, als eine Unterklasse der bewussten Erfahrungen. Ebenso ist das Gefühl des freien Willens zu einer Handlung – wie z. B. das Heben des Arms -, das manchmal auch als Handlungsfähigkeit bezeichnet wird [6,7], eine weitere Unterkategorie bewusster Erfahrungen. Ihr Inhalt unterscheidet sich zwar von dem des Schmerzempfindens oder des Rot-Sehens, aber die Subjektivität ist allen gemeinsam.