Wer bewacht NewsGuard? Akademiker, die bei der Arbeit schlafen – Tim Hayward

Quelle: Who Guards NewsGuard? Academics asleep on the job – Propaganda In Focus

Kürzlich las ich „eine wichtige Arbeit“, die mir von einem Philosophen empfohlen wurde, der sich auf Erkenntnistheorie spezialisiert hat (die Untersuchung, wie wir wissen, was wir zu wissen glauben). Die Arbeit (Chen et al. 2023) geht der Frage nach: „Erleichtern Online-Plattformen den Konsum von potenziell schädlichen Inhalten?“ Die Autoren bieten eine scheinbar rigorose Analyse von Verhaltens- und Umfragedaten, um Muster der Exposition gegenüber „alternativen und extremistischen Kanalvideos auf YouTube“ aufzudecken. Sie erklären jedoch nicht, was sie mit „schädlich“ oder „potenziell schädlich“ meinen, und geben auch keine Beispiele für die Art von „alternativen“ Inhalten, die sie im Sinn haben. Es stellt sich heraus, dass sie die Aufgabe, „potenziell schädliche“ Inhalte zu identifizieren, bereits von „NewsGuard“, einem „Bewertungssystem für Nachrichten- und Informationswebsites“, übernommen haben. Denn die Autoren lokalisieren das Schadenspotenzial in denjenigen Kommunikationskanälen, die laut „NewsGuard“ nicht glaubwürdige Informationen veröffentlichen.

Ich fand es rätselhaft, dass Akademiker sich auf eine externe Organisation verlassen, um die Glaubwürdigkeit von Informationen zu prüfen, die sie selbst zu beurteilen bereit sind. Man hätte erwarten können, dass Akademiker es als ihre eigene berufliche Verantwortung ansehen, die Stichhaltigkeit von Wissensbehauptungen zu überprüfen, auf die sie sich stützen, oder zumindest die Zuverlässigkeit der Methoden zu überprüfen, die andere dabei angewandt haben. Doch diese Autoren haben offenbar weder die Fundiertheit der Ergebnisse oder Methoden von „NewsGuard“ überprüft, noch zitieren sie Arbeiten anderer akademischer Forscher, die dies getan haben. Tatsächlich hat sich herausgestellt, dass sich zahlreiche andere akademische Forscher in diesem Bereich ebenfalls auf „NewsGuard“ verlassen haben, ohne eine Begründung für ihr Vertrauen in dessen Zuverlässigkeit zu liefern. Es scheint, dass die Tatsache, dass „alle anderen es auch tun“, zu einem sich selbst erfüllenden Präzedenzfall geworden ist. Niemand zitiert eine maßgebliche Quelle für den Präzedenzfall selbst!

Angesichts dieser offensichtlichen Bereitschaft von Akademikern, sich auf „NewsGuard“ zu verlassen, wird in diesem Artikel genauer untersucht, worauf sie sich dabei verlassen. „NewsGuard“ ist sowohl der Name eines Unternehmens als auch seines Produkts. Eine Reihe von Fragen betrifft daher die allgemeinen Ziele des Unternehmens und der Personen, die es gegründet haben, und diese werden in Abschnitt 2 kurz vorgestellt. Ein potenzielles Problem, das sich in diesem Zusammenhang ergibt, ist, dass die Personen, die hinter der Organisation stehen, alle aus hochrangigen Positionen im nationalen Sicherheitsstaat der USA kommen, während die Finanzierung der Journalisten von „NewsGuard“ von Einrichtungen stammt, die im Allgemeinen mit diesem Staat verbunden sind. Was das Produkt bzw. die Dienstleistung von „NewsGuard“ betrifft, so handelt es sich um etwas anderes als eine herkömmliche Faktenüberprüfung. Wie Abschnitt 3 zeigt, bietet „NewsGuard“ eine Bewertung nicht einzelner Inhalte, sondern von Inhaltsanbietern. Die von „NewsGuard“ angebotene Bewertung der „Glaubwürdigkeit“ bezieht sich auf einen Kommunikationskanal oder eine Medienplattform als Ganzes und nicht auf einzelne Inhalte, die dort veröffentlicht werden – obwohl „NewsGuard“, wie wir noch sehen werden, bei bestimmten brisanten Themen eine Ausnahme macht. Technisch gesehen handelt es sich bei dem Dienst um eine „Middleware“, d. h. eine digitale Schnittstelle, die es den Dienstanbietern ermöglicht, Inhalte durch die Anwendung von Algorithmen zu filtern, die so konzipiert sind, dass sie beliebige Auswahlkriterien anwenden, die den Entwicklern aufgetragen werden. Diese Art der Filterung kann im Prinzip potenzielle Vorteile für die Nutzer bringen, sie kann aber auch so eingesetzt werden, dass der Zugang der Nutzer zu Inhalten, die sie vielleicht gerne hätten, eingeschränkt wird. In Abschnitt 4 werden die Bedenken hinsichtlich der sozialen Auswirkungen der Aktivitäten von „NewsGuard“ dargelegt und Belege dafür untersucht, wie die Filterung zu problematischen Ergebnissen führen und auch den Zielen von Akteuren auf Regierungsebene dienen kann, die eine kritische öffentliche Debatte im Namen der „Bekämpfung von Desinformation“ unterdrücken wollen. Abschnitt 5 kehrt zu dem Anliegen zurück, das diesen Artikel ursprünglich motiviert hat: Warum verlassen sich Akademiker auf „NewsGuard“ und welche Auswirkungen hat dies? Meine Schlussfolgerung ist, dass Akademiker viel aufmerksamer auf die Risiken der vermeintlichen „Verteidigung der Demokratie“ durch Zensur achten müssen – denn was auf diese Weise verteidigt wird, wäre nur dem Namen nach eine Demokratie.

1. Für welches Problem soll “ Newsguard“ eine Lösung sein?

Um zu überprüfen, ob ich nicht etwas übersehen habe, was die Begründung oder Rechtfertigung dafür angeht, dass sich Wissenschaftler wie Chen et al. auf „NewsGuard“ verlassen, habe ich mir genau angesehen, wie sie die Prämissen ihrer Forschung festgelegt haben. Sie geben an, dass sie bei der Einstufung bestimmter YouTube-Kanäle als „potenziell schädlich“ die Ergebnisse früherer Untersuchungen von Ledwich und Zaitsev (2020), Lewis (2018), Charles (2020) und einer älteren, viel zitierten Arbeit von Stroud (2010) übernehmen. Sie geben jedoch keine Zusammenfassung oder einen Überblick darüber, was genau diese Forschungen beleuchten. Nachdem ich diese Artikel selbst überprüft habe, fand ich in allen vier Artikeln nur einen einzigen Hinweis auf schädliche Inhalte, nämlich Charles‘ Verweis auf weiße suprematistische Inhalte. Dies ist für den Teil der Studie von Chen et al. relevant, der sich auf ihre Liste von 290 extremistischen Kanälen bezieht, da die von ihnen erwähnten Beispiele einige ziemlich widerwärtige Inhalte zu enthalten scheinen – einige davon erscheinen auf traurig bekannte Weise sexistisch oder rassistisch. Auch wenn sie nicht als extremistisch im Sinne der Befürwortung von Terror, Gewalt oder Aufruhr definiert würden, könnte man dennoch argumentieren, dass Kanäle, die Sexismus und Rassismus fördern, potenziell schädlich sind. Und ich gebe zu, dass es wahrscheinlich nicht allzu schwierig ist, derartig anstößige Inhalte zu erkennen.

Aber das ist nicht die Sorge, die meine Untersuchung antreibt. Es bleibt zu verstehen, warum auch all jene Kanäle als potenziell schädlich bezeichnet werden, die nicht als extremistisch, sondern als alternativ eingestuft werden. Nach der Typologie von Chen und Kollegen „diskutieren alternative Kanäle kontroverse Themen durch eine Brille, die versucht, diskreditierte Ansichten zu legitimieren, indem sie sie als marginalisierte Standpunkte darstellen“. Diese Spezifikation ist in ihrer Anwendung wahrscheinlich tendenziös, da sie schwierige Fragen aufwirft: wie werden „diskreditierte Ansichten“ definiert und identifiziert; auf wessen normatives Urteil wird sich verlassen, um zu bestätigen, dass eine Ansicht „diskreditiert“ ist; und was rechtfertigt die Wahl des Schiedsrichters. Diese Fragen werden von den Autoren nicht behandelt. Dass dies als eine ernste Angelegenheit betrachtet werden sollte, habe ich in Bezug auf die Arbeit anderer „Desinformations“-Forscher argumentiert, wie z. B. derjenigen, die an staatlich geförderten Zensurmaßnahmen in den USA beteiligt waren (Hayward 2023).

Chen et al. scheinen jedoch ein Beispiel dafür zu nennen, was sie unter einem Kanal verstehen, der versucht, „diskreditierte Ansichten zu legitimieren“: Sie erwähnen, dass „der prominenteste alternative Kanal in unserer Typologie“, der 26% der gesamten mit Videos von alternativen Kanälen verbrachten Zeit ausmacht, der von Joe Rogan ist. Obwohl sie kein Beispiel dafür anführen, dass seine Show eine bestimmte diskreditierte Ansicht legitimiert, passt sie doch zu ihrer allgemeinen Kategorisierung von „alternativ“ als außerhalb des Mainstreams stehend. Diese Klassifizierung ist unumstritten, wenn sie als Beschreibung von Kanälen verwendet wird, die nicht zu den staatlichen und konzerneigenen Medien gehören, die manchmal auch als „Legacy Media“ bezeichnet werden. Chen und Kollegen fügen jedoch ein normatives Kriterium hinzu: Eine notwendige Bedingung für die Einstufung eines Senders als Mainstream ist, dass er „glaubwürdige Informationen veröffentlicht“. Wie in ihrer Diskussion deutlich wird, wollen sie damit jedoch nicht sagen, dass ein Mainstream-Medium unfehlbar glaubwürdige Informationen veröffentlicht. Es bleibt also unklar, wie oder in welchem Umfang diese Bedingung erfüllt sein muss. Auch wird nicht klargestellt, ob sie behaupten, dass alternative Medien niemals glaubwürdige Informationen veröffentlichen, oder ob sie dies einfach weniger tun als Mainstream-Medien. Jede dieser Klarstellungen würde die Art von gründlicher epistemischer Sorgfalt erfordern, die sie gänzlich vermeiden. Denn wir wissen bereits, dass Mainstream-Medien nicht immer glaubwürdig sind, und manchmal – vor allem, wenn sie Kriege anfeuern oder politische Skandale vertuschen – sind sie nicht nur potenziell, sondern tatsächlich schädlich.

Wie kommen die Autoren dann zu dem Schluss, dass die von einem Sender wie Rogan verbreiteten Informationen weniger glaubwürdig wären als die der Mainstream-Medien? Sie geben an, dass sie diejenigen Medien als glaubwürdig einstufen, die einen „NewsGuard“-Score von mehr als 60 haben. Offensichtlich wird also eine entscheidende Aufgabe – nämlich die epistemische Sorgfalt, die erforderlich ist, um eine bestimmte Ansicht zu „diskreditieren“ – an die „NewsGuard“-Organisation ausgelagert. Da wir normalerweise von akademischen Forschern erwarten, dass sie ihre eigene erkenntnistheoretische Sorgfalt walten lassen, wäre ein solches Maß an Vertrauen in ein drittes Unternehmen erklärungsbedürftig. Es wird jedoch keine angeboten. Wäre dies der Fall gewesen, dann wäre die Grundlage ihrer Studie in Frage gestellt worden. Hätten sie nämlich die Methodik und die Beispiele von „NewsGuard“ sorgfältig untersucht, hätten sie, wie ich zeigen werde, festgestellt, dass sie einen sehr lückenhaften und unzuverlässigen Leitfaden für die Vertrauenswürdigkeit von Quellen liefern. Es bietet keine echte Lösung für das Problem, dass man nicht weiß, wem man im Bereich der kontroversen Nachrichtenberichterstattung vertrauen kann.

Für welches Problem genau soll „Newsguard“ also eine Lösung bieten? Es geht nicht um das Problem eines Bürgers, der wissen will, wie er feststellen kann, ob ein bestimmter Bericht oder eine bestimmte Erzählung verlässlich oder unzuverlässig ist, denn „NewsGuard“ bewertet die Medienquellen, die sie übermitteln, und nicht die Qualität des Inhalts selbst. Das Problem, das „NewsGuard“ offensichtlich lösen soll, ist das der Menschen, die ihre Nachrichten aus Quellen beziehen, die es als unzuverlässig einstuft. Diejenigen, die von „NewsGuard“ abgelehnte Quellen nutzen, haben vielleicht selbst kein Problem damit. Um das Beispiel von Joe Rogans Show zu nehmen, hat „NewsGuard“ sogar einen ganz neuen Dienst entwickelt – die Podcast-Bewertung – als direkte Reaktion auf die einflussreiche Verbreitung von Perspektiven zu kontroversen Themen, die von den Mainstream-Orthodoxien abweichen. Ein Grund, warum Rogans Podcast so einflussreich ist, ist, dass er oft sehr interessante und gut informierte Gäste hat, die auf ernsthafte und durchdachte Fragen antworten. Die Hörer finden offensichtlich, dass diese Podcasts lohnende Perspektiven auf schwierige Themen bieten können, die in den Mainstream-Medien normalerweise nicht zur Sprache kommen. Nachdem ich selbst einige der Interviews gesehen habe, in denen er bohrende Fragen stellt und überlegte Antworten zulässt, würde ich sagen, dass er in diesen Fällen auf jeden Fall einen wertvollen öffentlichen Dienst leistet. Er ist bereit, wichtige Fragen zu stellen, die die Mainstream-Medien eifrig vermeiden.

Das bedeutet natürlich, dass er oft Ansichten vertritt, die denen zuwiderlaufen, die vom Sicherheitsstaat und den großen Unternehmen gefördert werden. Vielleicht weist dies auf das eigentliche Problem hin, zu dessen Lösung „NewsGuard“ geschaffen wurde.

2. Wer sind NewsGuard?

„NewsGuard“ ist ein gewinnorientiertes Unternehmen, das 2018 von Steve Brill, einem Medienunternehmer, der auch seit langem ein großzügiger Unterstützer der Demokratischen Partei der USA ist, und Louis Gordon Crovitz gegründet wurde, der unter anderem Vorstandsmitglied von „Business Insider“ ist, das vom Eigentümer der „Washington Post“, Jeff Bezos, über 30 Millionen Dollar erhalten hat. Laut Whitney Webb (2019), die einen gründlichen Untersuchungsbericht über „NewsGuard“ verfasst hat, „wurde Crovitz wiederholt beschuldigt, Fehlinformationen in seine Wall Street Journal-Kolumnen einzufügen und sich bei der Überwachung durch die National Security Agency (NSA) und anderen Themen ‚immer wieder bei den Fakten zu irren‚. Einige Unwahrheiten, die in Crovitz‘ Arbeit auftauchten, wurden nie korrigiert, selbst wenn seine eigenen Quellen ihn wegen Fehlinformationen anzeigten„.

Dem Beirat von „NewsGuard“ gehören hochrangige Mitarbeiter aus den Regierungen Clinton, Bush und Obama an. Darunter sind General Michael Hayden, ein ehemaliger CIA- und NSA-Direktor, und Tom Ridge, der als Heimatschutzminister von George W. Bush die Einführung des Farbcodierungssystems – wie das von „NewsGuard“ übernommene – in dem nach dem 11. September 2001 geschaffenen Warnsystem für Terrorbedrohungen beaufsichtigte (Webb 2019). Ein anderer ist Richard Stengel, ehemaliger Unterstaatssekretär für öffentliche Diplomatie unter Präsident Barack Obama, eine Position, die Stengel als „Chefpropagandist“ bezeichnete und erklärte, er sei „nicht gegen Propaganda. Jedes Land macht sie, und sie müssen sie für ihre eigene Bevölkerung machen, und ich denke nicht unbedingt, dass sie so schrecklich ist.“ (Webb 2019) Zu den anderen gehören: Don Baer, ehemaliger Kommunikationsdirektor des Weißen Hauses und Berater von Bill Clinton und derzeitiger Vorsitzender von „PBS“ und der einflussreichen PR-Firma „Burson Cohn & Wolfe“; Elise Jordan, ehemalige Kommunikationsdirektorin des Nationalen Sicherheitsrats und ehemalige Redenschreiberin von Condoleezza Rice; und Anders Fogh Rasmussen, ehemaliger Generalsekretär der NATO.

„NewsGuard“ hat Finanzmittel vom US-Verteidigungsministerium und dem Pentagon erhalten. Einer der wichtigsten Investoren von „Newsguard“ ist die „Publicis Groupe“, das drittgrößte globale Kommunikationsunternehmen der Welt (Webb 2019), zu dessen Kunden unter anderem die Pharmariesen „Eli Lilly“, „Merck“, „Pfizer“ und „Bayer“/“Monsanto“ sowie die Regierungen von Australien und Saudi-Arabien gehören (Webb 2019). Ein weiterer Großinvestor ist die „Blue Haven Initiative“, der „Impact Investment“-Fonds der Familie Pritzker, die der zweitgrößte Geldgeber von Hillary Clintons Präsidentschaftswahlkampf 2016 war (Webb 2019). Zu den weiteren Top-Investoren gehören John McCarter, eine langjährige Führungskraft beim US-Regierungsauftragnehmer „Booz Allen Hamilton“, sowie Thomas Glocer, ehemaliger CEO von Reuters und Mitglied der Vorstände des Pharmariesen Merck & Co, des Finanzriesen „Morgan Stanley“ und des „Council on Foreign Relations“ sowie Mitglied des „International Advisory Board“ des „Atlantic Council“. (Webb 2019) „NewsGuard wird auch von der Knight Foundation unterstützt, einer Gruppe, die Mittel vom „Omidyar Network“ und dem „Democracy Fund“ erhält, die beide zu der vom eBay-Gründer Pierre Omidyar geführten und unterstützten Agglomeration von Institutionen gehören“ (Artyukhina 2019). Die „Knight Foundation“ war auch ein wichtiger Geldgeber für das „Virality Project“ und die „Election Integrity Partnership“, die wegen ihrer Beteiligung an der Zensur heftig kritisiert wurden (wie ich kürzlich in einem verwandten Zusammenhang erörtert habe).

In Anbetracht der Verbindungen ihrer Direktoren, Berater, Investoren und Geldgeber ist es nicht überraschend, dass „NewsGuard“ durchweg negative Bewertungen für Medien abgibt, die dem US-Establishment und den Organisationen, mit denen sie verbunden sind, kritisch gegenüberstehen. Zu den kritischen Medien gehören insbesondere „Consortium News“ und „The Grayzone„.

Doch die Grundlage der negativen Bewertungen von „NewsGuard“ kann tendenziös oder schlichtweg falsch sein. Der Fall von „Consortium News“ (CN) ist ein Beispiel für eine offensichtlich unangemessene Bewertung. „Consortium News“ wurde 1995 von dem investigativen Reporter Robert Parry gegründet und hat schätzungsweise 27.000 Artikel veröffentlicht. Aus diesen fast drei Jahrzehnten des Journalismus heraus schreibt der Herausgeber Joe Lauria,

„NewsGuard“ fand nur sechs Artikel, die aufgrund der Verwendung von vier Wörtern und einer Phrase zu beanstanden waren. Die Wörter sind „verseucht“, „imperialistisch“, „Putsch“ und „Völkermord“, und die Phrase ist „falsche Flagge“. Das war’s. „NewsGuard“ hat jedoch nicht nur diese sechs Artikel markiert. Stattdessen wird jeder Artikel von „Consortium News“, der bis in die 1990er Jahre zurückreicht und heute im Internet zu finden ist, mit einer roten Markierung in Suchmaschinen und sozialen Medien verurteilt. (Lauria 2022b)

Die unangemessene und ungerechtfertigte Strenge des Urteils im Fall von „Consortium News“ kann mit der Nachsicht verglichen werden, die „NewsGuard“ gegenüber Mainstream-Sites walten lässt. Chris Hedges – selbst ein erfahrener Journalist, der früher für Mainstream-Seiten geschrieben hat – hat die Perversität einiger der Urteile von „NewsGuard“ hervorgehoben:

„NewsGuard“ gibt „WikiLeaks“ ein rotes Etikett, weil es „versäumt“ hat, Widerrufe zu veröffentlichen, obwohl es zugegeben hat, dass alle Informationen, die „WikiLeaks“ bisher veröffentlicht hat, korrekt sind. Was „WikiLeaks“ eigentlich zurückziehen sollte, bleibt ein Rätsel. Die „New York Times“ und die „Washington Post“, die sich 2018 den Pulitzer-Preis für die Berichterstattung über die Verschwörungstheorie von Donald Trump mit Wladimir Putin zur Beeinflussung der Wahl 2016 teilten, die durch die Mueller-Untersuchung widerlegt wurde, erhielten die volle Punktzahl. Bei diesen Bewertungen geht es nicht darum, den Journalismus zu überprüfen. Es geht darum, Konformität zu erzwingen. (Hedges 2022)

3. Was ist NewsGuard?

„NewsGuard“ ist sowohl der Name eines Unternehmens als auch des von ihm vertriebenen Produkts/Dienstes. Das Produkt, das den Dienst bereitstellt, kann als Middleware eingestuft werden. Middleware ist im Allgemeinen Software, die zwischen einem Betriebssystem und den darauf laufenden Anwendungen liegt; in diesem Zusammenhang kann sie als Filtersystem betrachtet werden, das auswählt, auf welche Daten der Browser eines Internetnutzers zugreifen kann und auf welche nicht. Middleware wurde in einem Bericht einer Stanford-Arbeitsgruppe unter der Leitung von Francis Fukuyama als technologische Form einer neuartigen Lösung zur „Bekämpfung von Fehlinformationen“ konzipiert und empfohlen (Fukuyama et al. (2020). Sie verwenden den Begriff für „Software und Dienstleistungen, die eine redaktionelle Ebene zwischen den dominanten Internetplattformen und den Verbrauchern einfügen würden“ (Fukuyama et al., 2020). Das Problem, das Fukuyama erkannt haben will, besteht darin, dass die Algorithmen, die die Social-Media-Plattformen antreiben, sowohl sozialen als auch politischen Schaden verursachen, „einschließlich der Bedrohung des demokratischen Diskurses und der Deliberation und letztlich der demokratischen Wahl im Wahlprozess“. Um solchen Schäden entgegenzuwirken, könnten „engagierte Community-Organisationen oder bevorzugte Medienorganisationen Middleware anbieten, sponsern oder unterstützen …, die dazu dienen könnte, Inhalte zu filtern, die in sozialen Medien und von Suchmaschinen präsentiert werden, und die sich entsprechend auf Nachrichten-Feeds und Suchergebnisse auswirken würde“. Die Autoren sprechen von einem „enormen Druck“ (allerdings ohne näher darauf einzugehen, woher dieser Druck kommt) auf „Plattformen, nicht nur illegale Inhalte aus ihren Bereichen herauszufiltern, sondern auch Material, das als politisch schädlich angesehen wird, wie Verschwörungstheorien, Fake News und beleidigende Inhalte“.

Als Middleware-Anbieter arbeitet „NewsGuard“ nicht wie herkömmliche Fact-Checking-Organisationen, indem es bestimmte kontroverse Nachrichten genau prüft. Er arbeitet nicht auf der Ebene spezifischer Geschichten, die in den digitalen Medien viral gehen könnten, sondern filtert die Inhaltsströme durch die Klassifizierung verschiedener Arten von Quellen. Wie wir gesehen haben, gibt es jeder einzelnen Website eine Bewertung auf der Grundlage von Beurteilungen, die sich auf die von ihr stammenden Stichproben beziehen. Der Mitbegründer von „NewsGuard“, Crovitz, hält es offenbar für einen Vorzug dieser Middleware, dass sie nicht durch die Notwendigkeit verzögert wird, bestimmte Geschichten mit epistemischer Sorgfalt zu prüfen: „Die Bewertung von Websites ist effektiver als die Faktenüberprüfung, die Unwahrheiten erst aufdeckt, wenn sie sich bereits verbreitet haben“. Die operative Maxime könnte also lauten: Erst zensieren, dann Fragen stellen – wenn überhaupt.

In Wirklichkeit handelt es sich bei „NewsGuard“ also um eine von der Regierung finanzierte Gruppe von Persönlichkeiten des Establishments, die mit dem Big Tech-Sektor zusammenarbeitet, um alle Informationsquellen zu unterdrücken, die Material veröffentlichen, das die Überzeugungen in Frage stellt, die sie in der Gesellschaft durchsetzen wollen. „NewsGuard“ wird als ein wirksames Mittel zur Erreichung dieses Ziels angepriesen. Denn es kann verschiedene Arten von Eingriffen vornehmen: Es kann die Veröffentlichungen der Plattformen mit Kennzeichnungen wie „Hassrede“ oder „ungeprüft“ versehen, ohne dass die Inhalte entfernt werden; es kann auch die Platzierung bei Google-Suchen, Facebook-Werbung und YouTube-Empfehlungen beeinflussen; und bei Bedarf kann es Inhalte ausblenden oder bestimmte Informationsquellen ganz blockieren.

Selbst ihre Befürworter sind sich bewusst, dass derartige Anwendungen von Middleware in den „falschen Händen“ beunruhigende Folgen haben können. Fukuyamas Gruppe schreibt:

Um sicherzustellen, dass Middleware keine Unterdrückung, etwa durch autokratische Regime, begünstigt, sollten solche Dienste nur auf freiwilliger Basis zur Verfügung stehen und so konzipiert sein, dass sie Zensur verhindern.

Das Problem ist jedoch, dass das „Opt-in“ von den Internetdienstanbietern ausgeübt werden kann und nicht notwendigerweise von den einzelnen Nutzern, und dass die Filter von Natur aus so konstruiert sind, dass sie Tätigkeiten ausüben, die als Zensur bezeichnet werden können. Obwohl Fukuyama et al. betonen, dass eine Vielzahl von Middleware-Anbietern wünschenswert ist, die den Nutzern die freie Wahl lassen, die Filter auszuwählen, die ihren Präferenzen entsprechen, bieten sie keinen Grund zu der Annahme, dass eine sinnvolle Vielfalt in der Praxis jemals zustande kommen wird. Und selbst für den unwahrscheinlichen Fall, dass ein sinnvoller Wettbewerb zwischen Anbietern wirklich unterschiedlicher Arten von Middleware entsteht und die Nutzer diese tatsächlich wünschen, könnte dasselbe „Problem“, das Middleware angeblich lösen soll, auf der Ebene der Regulierung der zulässigen Arten von Middleware-Filtern wieder auftauchen. Denn wenn man sich die aktuellen Einschaltquoten ansieht, könnte man erwarten, dass sich viele Menschen für einen Filter entscheiden, der z. B. Joe Rogan und nicht CNN enthält. Die Realität sieht jedoch so aus, dass „NewsGuard“ bereits eine marktbeherrschende Stellung innehat und vom Sicherheitsstaat erheblich unterstützt wird – wie die Zusammensetzung seines Beirats und die in ihn fließenden Finanzmittel zeigen -, um diese Position weiter zu festigen.

4. Die Auswirkungen von „NewsGuard“ auf die öffentliche Debatte

Die Dienste von „NewsGuard“ wurden bereits in erheblichem Umfang in Anspruch genommen, und der Co-Direktor von „NewsGuard“ kann auf einige große Erfolge verweisen:

Microsoft war das erste Technologieunternehmen, das unsere Bewertungen und Labels angeboten hat, indem es sie in seinen mobilen Edge-Browser integriert und den Nutzern des Edge-Desktop-Browsers kostenlosen Zugang gewährt hat. Internetprovider wie British Telecom in Großbritannien, Gesundheitssysteme wie Mt. Sinai in New York und mehr als 800 öffentliche Bibliotheken und Schulen in den USA und Europa bieten unsere Bewertungen und Kennzeichnungen über eine Browsererweiterung an, die rote oder grüne Kennzeichnungen neben Nachrichten in Social Media Feeds und Suchergebnissen einfügt. (Crovitz 2021)

Auch an den Universitäten ist es auf dem Vormarsch, da es über das Aufsatzprüfungsprogramm „TurnItIn“ bereitgestellt wird, um „vielen Millionen Studenten und Lehrern zu helfen, Fehlinformationen zu erkennen und zu vermeiden“ (Turnitin 2020). Die offensichtliche Unterstützung durch die US-Regierung lässt eine weitere Expansion erahnen.

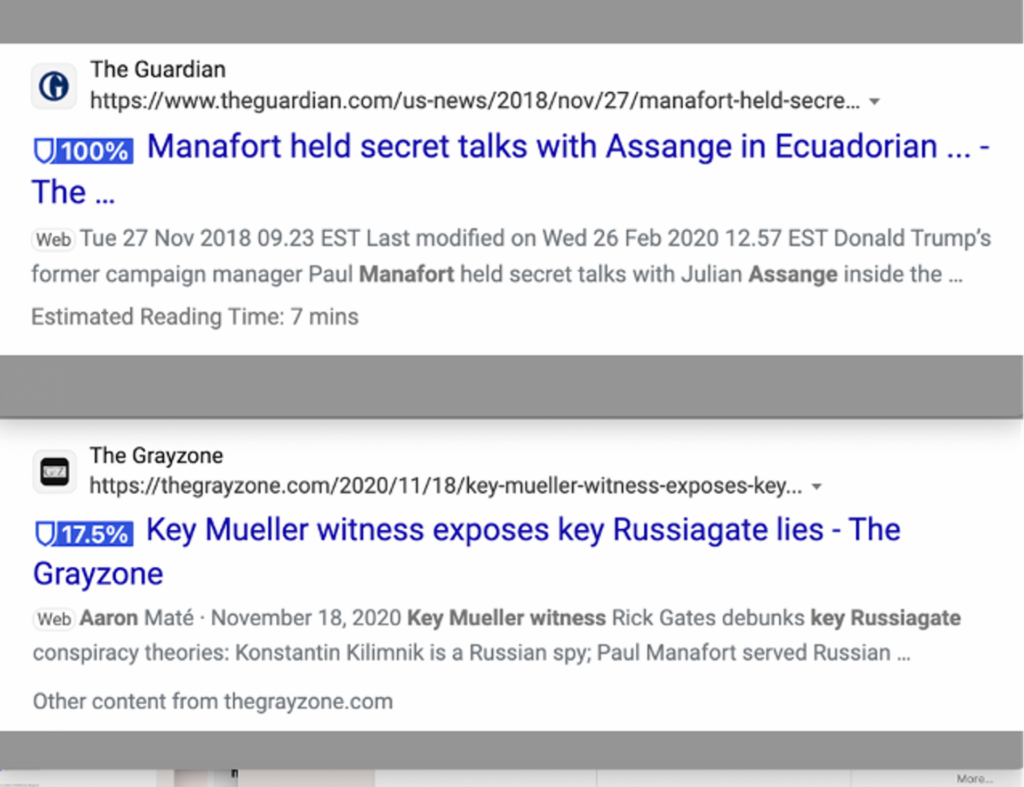

Wie vorteilhaft sich dies auswirken wird, ist eine andere Frage. Ein sehr grundsätzliches Problem ist die Art und Weise, wie „NewsGuard“ seine Bewertungen im Edge-Browser von Microsoft präsentiert. Denn obwohl offiziell behauptet wird, dass es die allgemeine Zuverlässigkeit einer Nachrichtenquelle bewertet, verleitet die Art und Weise, wie die Ergebnisse präsentiert werden – in derselben Zeile und in derselben Farbe wie die einzelnen Titel (siehe Abb. 1) – jeden Gelegenheitsleser, der die Methodik von „NewsGuard“ nicht studiert hat, zu der Annahme, dass es sich um eine Bewertung des verlinkten Artikels handelt. Nichts deutet unmittelbar darauf hin, dass die Bewertung tatsächlich für die gesamte Website gilt und dass der Artikel selbst überhaupt nicht überprüft wurde. Dementsprechend kann es sein, dass der Gelegenheitsnutzer nicht erkennt, dass jeder Artikel einer Website entweder geteert und gefedert oder beschönigt wird. So kommt es, dass eine nachweislich erfundene und unkorrigierte Geschichte im „Guardian“ – zum Beispiel über ein Treffen von Paul Manafort mit Julian Assange in der äquadorianischen Botschaft – als 100 % zuverlässig angezeigt wird, während ein Artikel, der solche Unwahrheiten in der „GrayZone“ aufdeckt, als höchst unzuverlässig eingestuft wird. Dies veranschaulicht, wie leicht das Bewertungssystem von „NewsGuard“ so irreführend sein kann, dass es die Wahrheit ins Gegenteil verkehrt.

Es ist natürlich problematisch, eine globale Bewertung auf der Grundlage einer kleinen Stichprobe von Artikeln zu vergeben, selbst wenn diese minimale Stichprobe gewissenhaft, fair und genau durchgeführt würde; aber wie wir im Fall von „Consortium News“ gesehen haben, ist „NewsGuard“ bereit, eine höchst selektive und unfaire Stichprobe für eine Website zu verwenden, die Mainstream-Narrative in Frage stellt – daher die unbefriedigende Bewertung von 47% für diese Website. Wenn wir uns jedoch ansehen, wie „NewsGuard“ zu dem Ergebnis von 17,5% für „The Gray Zone“ gekommen ist (das sogar noch unter dem von RT liegt, einem von mehreren Plattformen und Ländern verbotenen Sender, mit 20%), finden wir ein noch tieferes Problem.

Als Begründung für das schlechte Abschneiden von „GrayZone“ hat „NewsGuard“ einen Aufsatz verfasst, in dem die Website für die Veröffentlichung von Artikeln kritisiert wird, in denen der Maidan als von den USA unterstützter Putsch bezeichnet wird, sowie für die Berichterstattung über die OPCW-Untersuchung des angeblichen chemischen Angriffs in Douma, Syrien, im Jahr 2018. Dieser skizzenhafte, nicht belegte Aufsatz enthält sehr tendenziöse Darstellungen von sehr umstrittenen komplexen Fragen. Speziell zum Douma-Fall der OPCW kann ich als Gründungsmitglied der „Working Group on Syria, Propaganda and Media“ Stellung nehmen, die mehrere gründliche Briefing-Notizen zu diesem Fall erstellt hat und der erste Empfänger von Whistleblower-Dokumenten zu diesem Fall war. Die von Aaron Maté für „GrayZone“ verfasste Artikelserie zu diesem Thema ist meines Erachtens gründlich und erstklassig. Im Gegensatz dazu wiederholt der oberflächliche Bericht von „NewsGuard“ lediglich die Argumente der britischen und amerikanischen Regierungen, die sich auf den Bericht der OPCW-Leitung über den Vorfall stützen, und ignoriert die späteren Aussagen und Dokumente der OPCW-Wissenschaftler, die die Untersuchung tatsächlich durchgeführt haben (eine kommentierte Liste dieser Dokumente finden Sie hier). Diese haben gezeigt, dass der offizielle Bericht ihre Ergebnisse ernsthaft falsch wiedergibt, und es ist dieses kritische, auf Beweisen basierende Material – das von „NewsGuard“ ignoriert wurde -, das die „GrayZone“ in ihrer Berichterstattung hervorgehoben hat. Sich für Whistleblower einzusetzen und die Mächtigen zur Rechenschaft zu ziehen, galt zu Zeiten von Watergate oder den Pentagon Papers als vorbildlicher investigativer Journalismus, wird aber heute von „NewsGuard“ missbilligt.

Dies ist auch kein Einzelfall, bei dem „NewsGuard“ einen beklagenswerten Mangel an epistemischer Sorgfalt bei der Erstellung seiner Bewertungen an den Tag legt. Obwohl sich „NewsGuard“ offiziell auf die Bewertung von Quellen oder Bereichen spezialisiert hat, fungiert es als Faktenprüfer, der über die Begründetheit bestimmter Behauptungen zu bestimmten kontroversen Themen urteilt. Insbesondere (und vielleicht nicht überraschend angesichts der pharmazeutischen Interessen und des Militärs, die in seinem Beratungsgremium vertreten sind) hat es sich zu Themen wie Covid-19, Impfstoffen und dem Krieg in der Ukraine geäußert. Im Jahr 2021 überwachte „NewsGuard“ beispielsweise „Tausende von Nachrichtenseiten und deckte die Veröffentlichung irreführender Informationen über Impfstoffe und politische Wahlen auf“ (Pratelli und Petrocchi 2022). Trotz seiner selbstbewussten Erklärungen über „Fehlinformationen“ musste „NewsGuard“ jedoch im Nachhinein zugeben, dass es falsche Urteile veröffentlicht hatte. So musste „NewsGuard“ beispielsweise in Bezug auf den Ursprung des neuartigen Coronavirus und die so genannte „Lab Leak“-Hypothese bestätigen, dass:

… in 21 Fällen war unsere Ausdrucksweise nicht so vorsichtig, wie sie hätte sein sollen; in diesen Fällen hat NewsGuard entweder die Behauptungen der Websites über die Laborleck-Theorie falsch charakterisiert, das Laborleck als „Verschwörungstheorie“ bezeichnet oder fälschlicherweise unbewiesene Behauptungen über das Laborleck mit der separaten, falschen Behauptung, dass das COVID-19-Virus von Menschen gemacht wurde, zusammengefasst, ohne zu erklären, dass die eine Behauptung unbegründet und die andere falsch war.

Bemerkenswert ist auch, dass selbst in dieser scheinbaren Entschuldigung ein anderes problematisches Urteil bekräftigt wird. Denn obwohl die Behauptung, das Virus sei von Menschen gemacht, vielleicht nicht nachweisbar war, lieferte die Tatsache, dass das Virus aus einem Labor stammen könnte, in dem Viren mit Gain-of-Function-Technologie hergestellt wurden, genügend Grund, die Behauptung nicht kategorisch für falsch zu erklären. Generell gibt es keinen Grund für die Annahme, dass die von „NewsGuard“ bezahlten Mitarbeiter über die kollektive Kompetenz verfügen, den freien Meinungsaustausch unter Wissenschaftlern und Praktikern zu übertreffen, die solche komplexen und unsicheren Themen in öffentlichen Foren, einschließlich sozialer Medien, diskutieren.

Was „NewsGuard“ jedoch sehr gut kann, ist die Verstärkung der offiziellen Narrative. Darüber hinaus trägt seine Verwendung in Bibliotheken, Schulen und Webbrowsern dazu bei, diese Narrative im öffentlichen Bewusstsein zu verankern, zusammen mit der Wahrnehmung ihrer Herausforderer als Dummköpfe oder Schurken. Wie sich jedoch im Zusammenhang mit ähnlichen „Faktenüberprüfungs“-Projekten in diesem Zeitraum gezeigt hat, insbesondere dem „Virality Project“, das in einer Stellungnahme vor dem US-Kongress kritisiert wurde und nun vor Gericht steht – nicht zuletzt, weil es Behauptungen, die in Wirklichkeit wahr waren, als Desinformation verurteilt hat -, bestand diese Art der „Korrektur“ allzu oft darin, falsche Behauptungen zu bestätigen.

Tatsächlich wurde „NewsGuard“ selbst kürzlich in einer von „Consortium News“ eingereichten Klage zitiert, in der eine Verurteilung wegen Verleumdung und Strafschadensersatz für Bürgerrechtsverletzungen gefordert wird. In der Klage wird behauptet, dass „die Vereinigten Staaten von Amerika und NewsGuard … in direkter Verletzung des Ersten Verfassungszusatzes amerikanische Medienorganisationen, die sich der amerikanischen Außen- und Verteidigungspolitik widersetzen, verleumden, stigmatisieren und diffamieren ….“. Im Rahmen einer Vereinbarung mit dem „Department of Defense Cyber Command“, einem Teil der Geheimdienstgemeine, „werden Medienorganisationen, die die Außen- und Verteidigungspolitik der USA in Bezug auf Russland und die Ukraine in Frage stellen oder anfechten, von NewsGuard an die Regierung gemeldet und als ‚anti-amerikanisch‘, Lieferanten russischer ‚Fehlinformationen‘ und Propaganda, die ‚falsche Inhalte‘ veröffentlichen und journalistische Standards nicht einhalten, bezeichnet. Da NewsGuard aufgrund seines Vertrags mit der Regierung verpflichtet ist, ‚vertrauenswürdige Quellen zu finden‘, liegt ein Verstoß gegen den Ersten Verfassungszusatz vor, der es ‚der Regierung nicht gestattet, Nachrichtenquellen auf ihre Zuverlässigkeit, ‚Vertrauenswürdigkeit‘ oder Rechtgläubigkeit hin zu überprüfen oder zu klären“.

Es kann daher als besorgniserregend angesehen werden, dass „NewsGuard“ bereits eine beherrschende Stellung als Medienfilter einnimmt. Es scheint wenig Aussicht auf das zu bestehen, was Fukuyama und seine Kollegen in ihrer idealisierten Vision eines gesunden, auf die Verbrauchernachfrage reagierenden Wettbewerbs darstellten, als sie schrieben, dass „[eine] wettbewerbsfähige Schicht neuer Unternehmen mit transparenten Algorithmen eintreten und die redaktionellen Gateway-Funktionen übernehmen würde“. Sie haben weder erklärt, was den Wettbewerb anregen würde, noch haben sie vorhergesagt, wie viel staatliche Investitionen in ein bestimmtes Produkt fließen würden. Dementsprechend haben sie das Risiko, dass ein Unternehmen wie „NewsGuard“ von der Regierung als Instrument für Zensurbemühungen eingesetzt werden könnte, die gegen den Ersten Verfassungszusatz der USA verstoßen würden, wenn sie von einer vergleichbaren Organisation durchgeführt würden, die direkt dem Ministerium für Innere Sicherheit unterstellt ist, nicht in Betracht gezogen.

Wie unvorhergesehen oder unerwünscht diese Aussicht für Fukuyama war, ist keine Frage, über die ich hier spekulieren möchte, obwohl Mike Benz in einer Reihe von Minivorträgen auf Twitter hervorgehoben hat, dass Fukuyamas frühere Karriere im „Office of Policy Coordination“ des US-Außenministeriums verlief, das mit der CIA koordiniert, um sicherzustellen, dass offene und verdeckte Außenpolitik synchronisiert werden, und das viele „Schwergewichte der Zensurindustrie“ hervorgebracht hat. Fukuyama hat seitdem bei anderen Organisationen gearbeitet, die mit der nationalen Sicherheit verbunden sind, darunter die „RAND Corporation“. In seiner jetzigen Position in Stanford gehören zu seinen Kollegen Alex Stamos und Renee diResta, die ich in einem früheren Artikel vorgestellt habe.

Es ist jedoch nicht nötig, über die Absichten zu spekulieren, denn die Realität – weit entfernt von Fukuyamas postuliertem Ideal – ist, dass „NewsGuard“ eine zentrale Position bei der Entwicklung und Umsetzung von Plänen auf Regierungsebene zur „Bekämpfung von Desinformation“ einnimmt, und das nicht nur in den USA.

„NewsGuard“ hat an der Datenüberwachung der Europäischen Kommission mitgewirkt, die „Online-Fehlinformationen aufspürt“ (NewsGuard 2022), und ist eines der Unternehmen, die an der Überarbeitung des Verhaltenskodex für Desinformation für Social-Media-Plattformen durch die Kommission beteiligt sind (NewsGuard 2021). Die Taktik in diesem „Informationskrieg“ beschränkt sich nicht nur auf die Kennzeichnung veralteter Kanäle, sondern umfasst auch die Unterbindung ihrer Finanzierung, insbesondere durch gezielte Werbeeinnahmen.

Bei der Ankündigung geplanter Überarbeitungen zur Stärkung des Kodexes sagte Věra Jourová, Vizepräsidentin der Europäischen Kommission und zuständig für Werte und Transparenz: „Online-Akteure tragen eine besondere Verantwortung für die Verbreitung und Monetarisierung von Desinformationen.“ (NewsGuard 2021)

Die Europäische Kommission hat ihren Kodex als den ersten „weltweiten Rahmen vorgestellt, der die Verpflichtungen der Plattformen und der Industrie zur Bekämpfung von Desinformation festlegt“. (Europäische Kommission 2021) Tatsächlich hatte der „German Marshall Fund“ (GMF) bereits eine Zusammenarbeit zwischen den USA und Europa vorgeschlagen, die speziell auf Finanzierungsströme mit dem Ziel abzielt, „die Anreizsetzung von Internetplattformen zu verändern“ (GMF-Experten 2021).

Eine Woche, nachdem die Europäische Kommission ihren Kodex aktualisiert hatte, gab die „Global Alliance for Responsible Media“ (GARM), eine vom Weltverband der Werbetreibenden ins Leben gerufene Initiative zur Förderung verantwortungsvoller Werbepraktiken, zum ersten Mal bekannt, dass sie „Fehlinformationen“ in die Liste der Online-Schäden aufgenommen hat, die sie als unangemessen für die Unterstützung von Werbung erachtet. Die früheren GARM-Standards, die sich auf Themen wie Pornografie und Gewalt bezogen, wurden von der Branche weitgehend übernommen. (NewsGuard 2022) Diese neuen globalen Standards „zwingen Marken und Ad-Tech-Unternehmen, Werbung im Wert von 2,6 Milliarden Dollar für Fehlinformationen zu stoppen“ (NewsGuard 2022). „NewsGuard“ hat sich aktiv um eine „schnellere Einhaltung“ dieser GARM-Anforderungen bemüht, „um die 2,6 Milliarden Dollar schwere Industrie der werbegestützten Fehlinformationen anzugehen“ (NewsGuard 2022). Außerdem sind diese neuen Standards laut Co-CEO Brill nur der Anfang, der glaubt, „dass der Erlass weiterer Vorschriften zu diesem Thema nahezu unvermeidlich ist.“ (NewsGuard 2022)

„NewsGuard“ ist nun ein integraler Bestandteil eines monolithischen Systems der Informationskontrolle, das der ehemalige Mitarbeiter des Außenministeriums Mike Benz als Zensurindustrie bezeichnet hat:

Von 2006 bis 2016 war die Zensur ein Akt. In den darauffolgenden fünf Jahren wurde die Zensur zu einer Industrie. Zu ihren mächtigen Akteuren gehören nun alle großen Medienkonglomerate, alle großen Online-Zahlungsanbieter, alle großen Hochschulen und Universitäten in den USA und im Vereinigten Königreich, Hunderte von Denkfabriken, Nichtregierungsorganisationen und Interessengruppen, internationale Regulierungs- und Überwachungskommissionen, und sie ist nun fest mit der Politik und den Tätigkeiten des US-Außenministeriums, des Pentagons und der Geheimdienste verwoben. (Benz 2022)

Die vorliegende Untersuchung der Ziele, Methoden und Erfolge von „NewsGuard“ – in Verbindung mit meinem früheren Blick auf damit verbundene Unternehmungen wie die „Election Integrity Partnership“ und das „Virality Project“ – legt die begründete Befürchtung nahe, dass es bei der „Bekämpfung von Desinformation“ in Wirklichkeit nur darum geht, zu verhindern, dass Meinungen, die von globalen staatlichen Akteuren missbilligt werden, auf breiter Front Gehör finden.

5. Einfluß auf die Welt der Wissenschaft

Man könnte erwarten, dass informierte Beobachter über diesen Anstieg der Zensur besorgt sind, vor allem angesichts der anfechtbaren Grundlage; und man könnte erwarten, dass Akademiker an vorderster Front stehen, wenn es darum geht, diese informierte Sorge zu artikulieren. Denn freie Kommunikation ist für die Ausübung von Wissenschaft und Forschung unerlässlich. Leider haben sich diese Erwartungen bei weitem nicht erfüllt. Diejenigen Akademiker, die von der Existenz von „NewsGuard“ wissen, betrachten es zumeist als Anbieter eines Dienstes, der es ihnen ermöglicht, Muster von „Fehlinformation“ oder „Desinformation“ zu untersuchen, ohne dass sie selbst die so abgelehnten Inhalte mit der nötigen Sorgfalt prüfen müssen. Der Einfluss von „NewsGuard“ auf das akademische Denken zeigt sich darin, dass „Google Scholar“ 940 Einträge mit „NewsGuard“ als Suchbegriff liefert (Stand: 27. September 2023). Eine informelle Übersicht über diese Literatur zeigt, dass sich die meisten der gefundenen Artikel mit der algorithmischen Identifizierung von „Fehlinformationen“ befassen, wobei die Quellenseite als Stellvertreter für diese verwendet wird. Obwohl „NewsGuard“ also nicht behauptet, Artikel individuell zu bewerten, werden seine Pauschalurteile für Quellen im Allgemeinen als etwas sehr Ähnliches angesehen. Einige Wissenschaftler bezeichnen es sogar als Faktenprüfer (z. B. Sharma et al. 2020). Eine Annahme, die durch den Ansatz von „NewsGuard“ gefördert wird, ist, dass ein Artikel von einer mit einer roten Markierung versehenen Website wahrscheinlich unzuverlässig ist, während ein Artikel von einer mit einer grünen Markierung versehenen Website im Allgemeinen zuverlässig ist. Zhou et al. gehen sogar davon aus, dass „NewsGuard die Grundwahrheit für die Erstellung von Nachrichtendatensätzen … zur Untersuchung von Fehlinformationen geliefert hat“ (Zhou et al. 2020, 3207).

Eine bemerkenswerte Anzahl akademischer Forscher begnügt sich damit, Projekte auf die Bewertungen von „NewsGuard“ zu stützen. In der Regel wird dies damit begründet, dass es dafür in der wissenschaftlichen Literatur Präzedenzfälle gibt. Broniatowski et al. (2022) stellen fest, dass diese Annahme in früheren Arbeiten weit verbreitet ist, und führen sechs Beispiele für Artikel an, die auf dieser Annahme beruhen. Typisch ist Lasser et al. (2022), die erklären, dass sie die Vertrauenswürdigkeit von Tweets von Politikern bewerten, indem sie das „NewsGuard“-Rating der Domains, auf die sie verlinken, überprüfen. Dabei erklären sie, dass sie „den Methoden prominenter Forschungsarbeiten über die Vertrauenswürdigkeit von Informationen folgen“. Typisch ist auch, dass sie keinerlei Hinweis auf eine Erklärungs- oder Rechtfertigungsgrundlage geben, auf der dieser Präzedenzfall beruht. In der Tat sind einige Forscher in diesem Bereich so weit von jeglichem Gefühl entfernt, dass tatsächliche epistemische Sorgfalt wichtig sein könnte, dass sogar vorgeschlagen wird, dass die Art der Glaubwürdigkeitsbewertung, die „NewsGuard“ vornimmt, stärker automatisiert werden könnte (siehe z. B. Aker et al).

Darüber hinaus sind einige Akademiker bereit, sich nicht nur auf die Bewertungen auf Website- oder Domänenebene zu verlassen. Wie bereits erwähnt, werden bei bestimmten kontroversen Themen Urteile über bestimmte Inhalte seitens „NewsGuard“ in den Vordergrund gerückt. Angesichts der wackeligen Grundlage und der inhärent problematischen Natur dieser Urteile ist es zudem besorgniserregend, dass sie manchmal unkritisch akzeptiert und in akademischen Publikationen verstärkt werden. So stellen Zhou et al. (2020) in einer Arbeit, die bis zum 26. September 2023 bereits 170 Mal zitiert wurde, als Tatsache fest, dass „[h]underte von Nachrichten-Websites zur Veröffentlichung falscher Coronavirus-Informationen beigetragen haben“, wobei die Referenz für diese Behauptung diese „NewsGuard“-Seite ist, die, wie bereits gezeigt, voll von umstrittenen und sogar fehlerhaften Behauptungen ist.

Kurz gesagt, es gibt Grund zu der Annahme, dass die Auswirkungen von „NewsGuard“ auf die Wissenschaft schädlich sind – nicht nur für die Wissenschaft, sondern auch für die Gesellschaft insgesamt. Aber es sind die Akademiker selbst, die diese Wirkung zugelassen haben. Die Gründe für die Akzeptanz von „NewsGuard“ liegen auf der Hand: Es wird viel Geld in die „Desinformationsforschung“ gepumpt, die der gewünschten Agenda der Geldgeber folgt. Wie das funktioniert, habe ich bereits in meiner kürzlich erschienenen Studie „Academic Complicity in Censorship: the Case of Kate Starbird“ dargelegt. Es gibt leider wenig Grund zu der Annahme, dass sich dieser Trend in naher Zukunft umkehren wird. Aber es bleibt möglich, dass Akademiker, die noch in der Lage sind, generell unabhängige Forschung zu betreiben, zumindest bei „dritten“ Kollegen – wie zum Beispiel dem Philosophen, der mich auf diese Untersuchung angesetzt hat – das Bewusstsein für den faustischen Handel schärfen, den andere in unserer Gemeinschaft eingegangen sind.

Zusammenfassung

Die Zensur wird immer mehr zur Normalität. Der frühere Schutz der Gedanken- und Meinungsfreiheit sowie die Garantien für die akademische Freiheit werden immer mehr ausgehöhlt und an den Rand gedrängt. Neue Einrichtungen wie NewsGuard werden als Schutz für Bürgerinnen und Bürger – und sogar für akademische Gemeinschaften – vor den angeblichen Gefahren und Schäden der Desinformation angepriesen. Die wirkliche Gefahr besteht jedoch darin, dass unsere Möglichkeiten, Ideen auszutauschen und andere Sichtweisen zu erlernen, immer mehr eingeschränkt werden und uns ungeschützt gegen die monolithische Auferlegung der offiziell verordneten „Wahrheit“ lassen, zu deren Verwirklichung „NewsGuard“ bereits einen wichtigen Beitrag leistet.

Wer hält Wache, um uns vor dem „Schutz“ durch „NewsGuard“ zu schützen? Angesichts der Stellung der Universitäten in der gesellschaftlichen Arbeitsteilung würde man erwarten, dass Akademiker die Methoden und Ergebnisse von „NewsGuard“ kritisch hinterfragen. Doch wie hier angedeutet, scheinen die Akademiker derzeit größtenteils bei der Arbeit zu schlafen – oder den Anreiz zu akzeptieren, der durch die üppige Finanzierung der „Desinformationsforschung“ geschaffen wird, um in die andere Richtung zu schauen. Es scheint daher, dass wir als Bürger die vernachlässigte epistemische Sorgfalt selbst aufbringen müssen, indem wir kritisch darüber diskutieren, was sie tut und wie wir uns ihr widersetzen können, solange wir noch sinnvolle Möglichkeiten dazu haben.